继特斯拉之后,小鹏汽车的端到端大模型也开始OTA上车了。5月20日,小鹏汽车在520 AI DAY发布会上,正式发布了AI天玑系统,实现了端到端AI智驾大模型上车。按照OTA推送规划,发布会当天小鹏汽车已经陆续为X9/G9/P7i/G6开启全量推送,此外小鹏P7将于三季度开始公测,而P5/G3i/G3则将于明年一季度开始公测。

AI天玑系统其实没什么太多可说的,虽然也融入了AI大模型,带来了AI小P、AI司机和AI保镖三大功能,相比小鹏过去的座舱智能化体验提升了一大截。但整体的智能化水平或者说体验,并没有与当下智能座舱体验形成“天翻地覆”的改变和代差。

发布会上真正的重头戏,还是“端到端智驾大模型”的正式上车。对此,发布会上小鹏汽车董事长何小鹏甚至还表示:“无AI不智驾。”那么,基于端到端AI智驾大模型的智驾系统,与传统智驾有何不同?小鹏的“端到端智驾大模型”,又有哪些优势?

“端到端”与传统智驾有何不同?

为了更容易理解小鹏的“端到端智驾大模型”技术,我们还是先来了解下,传统智驾系统是如何实现智能驾驶的。

传统的智驾系统,采用的是“模块化”智驾路线,它将自动驾驶系统划分为三层:环境感知层、决策规划层和控制执行层。每一层还可以划分为不同的模块,每个模块还可以划分为不同的子模块……整个智驾方案,极为依赖于工程师通过一行行代码制定的规则,从而驯化自动驾驶车辆。

而这就会面临两个比较大的问题:首先,智驾系统的各独立模块,相互之间的信息是逐级传递的,而在传递整个过程中,会存在信息的丢失和误差,并且前一个模块的误差会影响到下一个,在此过程信息误差会不断积累,最终影响到自动驾驶方案的整体效果。其次就是,这种路线会导致整个系统非常复杂、庞大,需要人工设计成百上千个模块。更重要的是,它的边际效应会随着智驾能力的提升,呈现几何式骤减,因为到后期需要制定的细化“规则”,会越来越多、越来越复杂。简单理解就是,可能我们只需花10%的时间、精力,就解决了99.9%的问题,但解决剩下的0.1%问题,可能需要花费90%甚至更多的时间和精力。

何小鹏给了具体的概念:较为稳定的传统量产智驾系统,大约有10万条左右各类人工定义的规则。即使这样,功能仍然无法超越L2,体验也是参差不齐。而经过测算,一个无限接近人类司机的自动驾驶系统,大概等效于10亿条规则——实非人力所能为。所以,“端到端”智驾路线便应运而生。那,什么是“端到端”?简单理解,“端到端”就是通过算法直接由输入求解出所需的输出,即算法直接将系统的输入端连接到输出端。放在智驾系统中,则是指车辆将传感器采集到的信息,直接发送到一个统一的深度学习神经网络,神经网络经过处理之后,直接输出自动驾驶汽车的驾驶命令。换句话说,基于AI神经网络,智驾系统在海量数据的训练下,会自主学习、模仿人类的驾驶经验。

“端到端”的优势在于,一方面,由于是“端”到“端”所以不存在信息丢失、误差等问题;另一方面,也不存在“模块化”中“穷举法”的边际效应骤减问题,因为AI能够自主不断优化、升级,具备更快的迭代效率,有效降低维护、迭代成本。不过,“端到端”也存在一个很大问题,那就是它所依赖的“深度学习神经网络”,是一个完完全全的黑盒子,不具解释分析性,可靠性、灵活性差,工程师们没有办法对它进行系统化的解释分析,而是只能依靠推测和实验进行调整。最终带来的结果是安全难以得到保障,而这也是为何所有AI都需要天量数据“投喂”的原因所在。用一个形象的例子来类比的话,同样是不让小孩触碰刀,“模块化”是需要跟孩子一个个说“菜刀危险,不能碰”、“水果刀危险,不能碰”、“剁骨刀危险,不能碰”等等;而“端到端”则是让孩子自己不断去尝试,只有被“刀”伤到了,那么他自己就会慢慢知道,“长这样的东西,不能碰,很危险”。正是考虑到两条路线的成本,以及未来的技术迭代和突破空间,越来越多车企和供应商,开始转向“端到端”智驾路线。除了这次举办发布会的小鹏外,蔚来、理想也都陆续公布了自己的端到端大模型上车时间表,而且都集中在2024年上半年。

小鹏的“端到端”能做什么?

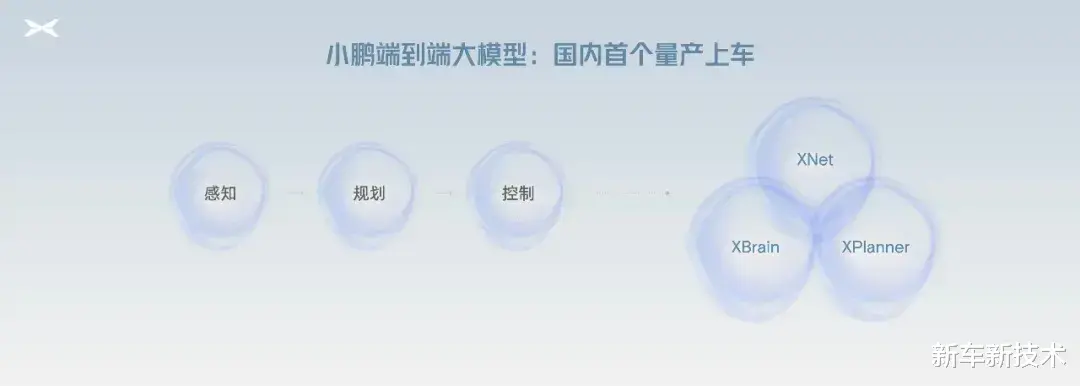

全球率先将“端到端智驾大模型”量产上车的是特斯拉,按马斯克的说法,FSD V12 是有史以来第一个端到端 AI 自动驾驶系统。而国内,小鹏汽车是首家宣称实现“端到端智驾大模型”量产上车的车企。

不过,小鹏汽车并没有完全做到“一体化”的“端到端智驾大模型”,而是将其分为三个组成部分:神经网络XNet、规控大模型XPlanner和大语言模型XBrain,通过三网融合,形成了小鹏自己的“端到端智驾大模型”。对此,何小鹏还特别强调,端到端智驾大模型体系下不是只有神经网络,实际上目前也没有任何一个玩家将整个体系完全AI化。“三网”中的神经网络XNet,更多的是实现“感知”层面的功能。它能将摄像头采集到的信息,通过动态XNet+静态XNet+2K占用网络,用超过200万个网格重构世界,对现实世界中的可通行空间进行3D高真实度还原,能够识别动态障碍物(行人、车辆等)、静态障碍物(水马、路障等)、路面标识(箭头、车道线等)信息,进行纯视觉感知识别。感知范围面积可达1.8个足球场大小,同时识别50+个目标物。

规控大模型XPlanner,负责的则是“模块化”智驾路线中的“决策规划”和“控制执行”功能。它有点类似于人类的小脑,能够基于图像数据的感知输入,实现对智驾行驶路径的规划控制。相比“模块化”智驾路线中的“决策规划”模块,它的优势在于没有复杂繁多的其它子模块,不需要人类手写规则代码,完全依靠神经网络模型,通过海量数据的不间断训练,使驾驶策略不断进化,向人类驾驶习惯和驾驶思维靠近。而AI大语言模型XBrain,这相当于给了智能驾驶辅助系统超越“感知”的“认知”能力。能够认识待转区、潮汐车道、特殊车道、路牌文字,秒懂各种令行禁止、快慢缓急的行为指令,进而做出兼顾安全、性能的拟人驾驶决策。比如,它可以读懂路上的字“前方道路施工,请换道”等环境信息,并执行对应操作。

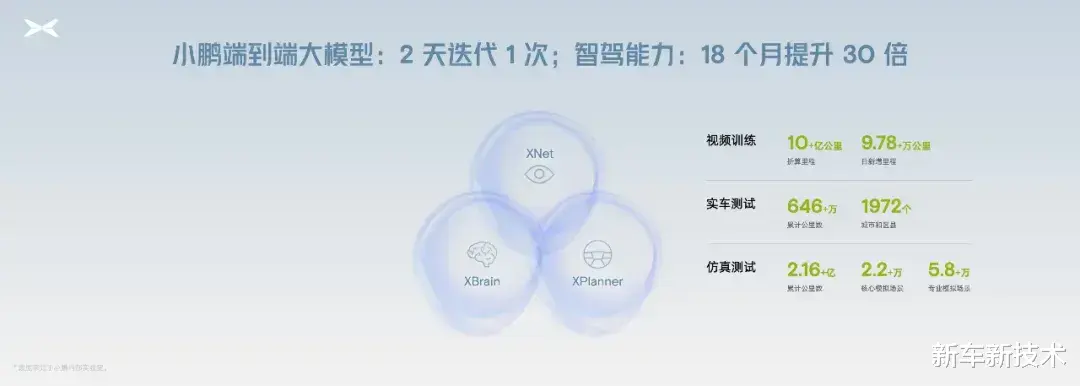

而按照何小鹏的说法,目前小鹏汽车“端到端智驾大模型”,能够做到“2天迭代一次”。在未来18个月内,XNGP的能力可以提升30倍(接管率指标)。这也是端到端的技术优势之一,只要在稳定大量优质数据来源的情况下,就能以“一日千里”的速度迭代进步。

从小鹏汽车这次发布的“端到端智驾大模型”来看,的确解决了“模块化”智驾路线会面临的诸多问题,大幅度降低了“子模块”的数量,以及需要“穷举法”来人工敲写代码制定规则的方式,将“AI大模型”融入到了智驾系统中,大幅提升智驾能力的迭代效率。不过,我们也要看到,小鹏这次发布的“端到端智驾大模型”,并非真正意义上的“端到端”,它依旧还是分为了几个大模块,通过“三网融合”实现“端到端智驾大模型”的能力。在看完小鹏汽车整场技术发布会后,笔者更加期待理想、蔚来,乃至华为的“端到端智驾大模型”,不知道他们的“端到端”到底会与小鹏汽车有何不同。

从全球范围来看,中国已经成为美国之外,全球自动驾驶技术最领先的国家,越来越多像小鹏、华为这样的公司,都在共同推动中国自动驾驶技术的迭代和发展。随着小鹏汽车“端到端智驾大模型”的量产上车,相信未来中国汽车的自动驾驶技术,也将迎来更快发展和机遇。