苹果发布最新机器学习研究:传统上,从RGB图像进行的密集3D重建假设相机姿势稳定。 即使近期的研究越来越关注移动设备的即时方法,这种假设仍然存在。 然而,这种一个图像对应一个姿势的假设在线上执行中并不成立:即时 SLAM 产生的姿势是动态的,可能会在事件发生后进行更新,例如捆绑调整和循环闭合。 这一问题在RGB-D环境中已得到解决,通过拆分过去的视图并将它们与更新的姿势重新整合,但在仅有RGB的情况下仍然很少被处理。

LivePose 线上3D重建

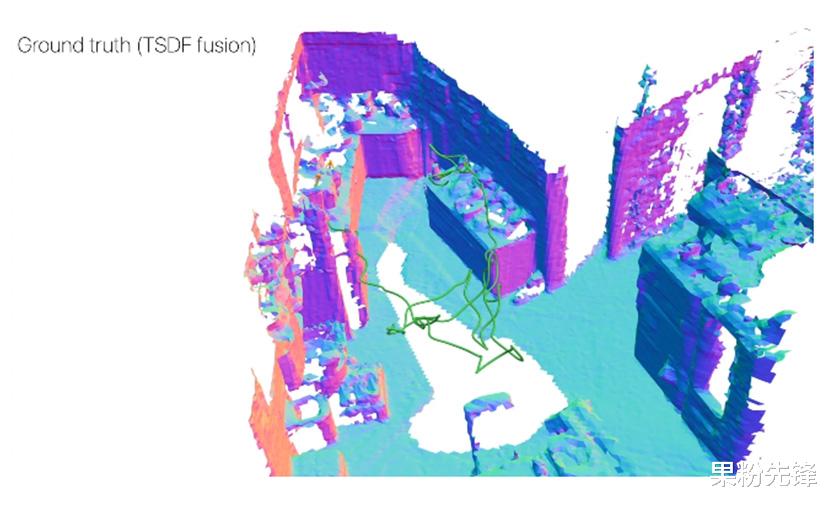

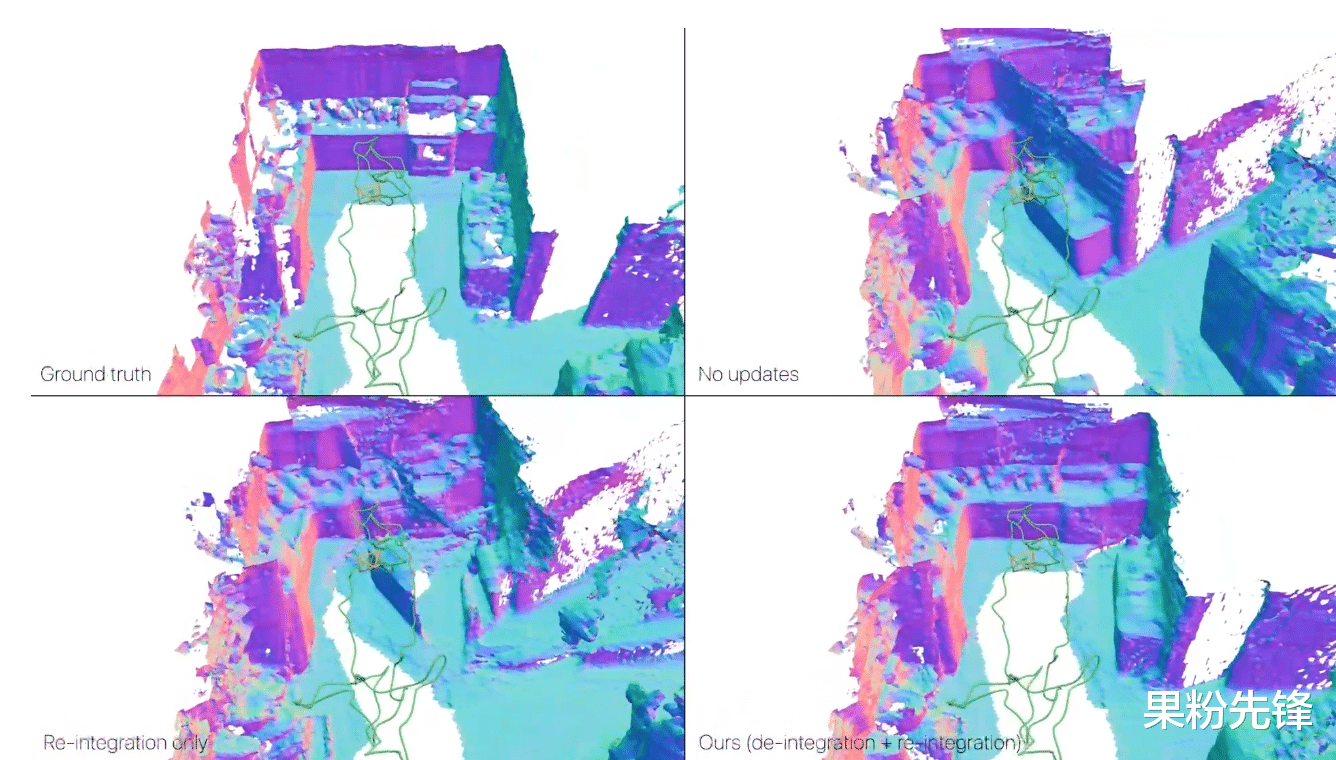

苹果对这一问题进行了正式定义,以确定从具有动态姿势的图像进行线上重建的新任务。 为了支持进一步的研究,我们引入了名为LivePose的数据集,其中包含运行在ScanNet上的SLAM系统的动态姿势。 我们选择了三种最新的重建系统,并应用了一个基于拆分的框架,以适应每个系统的动态姿势设置。 此外,我们提出了一个新的非线性拆分模块,该模块学习去除过时的场景内容。 我们展示了对姿势更新的反应对于高质量的重建至关重要,而我们的拆分框架是一个有效的解决方案。

动态特性的重建

新算法根据历史当前观测结果产生精确的增量重建,解决了同步定位和地图映射(SLAM)系统的动态特性,确保与 SLAM 更新保持一致。

改变假设:动态相机姿势

先前在密集的纯RGB重建方面,很大程度上忽略了线上应用中相机姿态估计的动态特性,在重建过程中依然采取静态输入图片的传统表述。

革命性的算法整合

科学研究团队在算法中纳入了动态特性,并将其整合到现有的RGB技术中。 团队受 BundleFusion(一种采用线性更新算法将新视图整合到场景中的RGB-D技术)的启发,探索解构了旧视图,然后重新整合提供位置资料。

非线性去整合的技术

苹果和加州大学圣塔芭芭拉分校的研究人员引入了一种独特的基于深度学习的非线性去整合技术,该技术专门用于促进 NeuralRecon 等技术的线上重建,该技术依赖于学习的非线性更新规则。

LivePose 资料

为了验证他们的方法,他们引入了LivePose资料集,这是一个开创性的资源,包含使用BundleFusion产生的ScanNet的完整动态姿势序列。 该数据集是评估其技术和促进未来研究的关键工具。

结论

这项突破有可能为增强现实、虚拟现实和其他需要精确3D建模的产业带来新的可能性。 通过充分理解相机姿势的动态特性,我们能够实现更高质量的线上 3D 重建,为未来的应用提供了更多可能性。 无论是虚拟现实,扩增现实还是其他领域,LivePose的技术将为我们带来更真实且令人兴奋的体验。