[LG]《ArcMemo: Abstract Reasoning Composition with Lifelong LLM Memory》M Ho, C Si, Z Feng, F Yu... [University of California, San Diego] (2025)

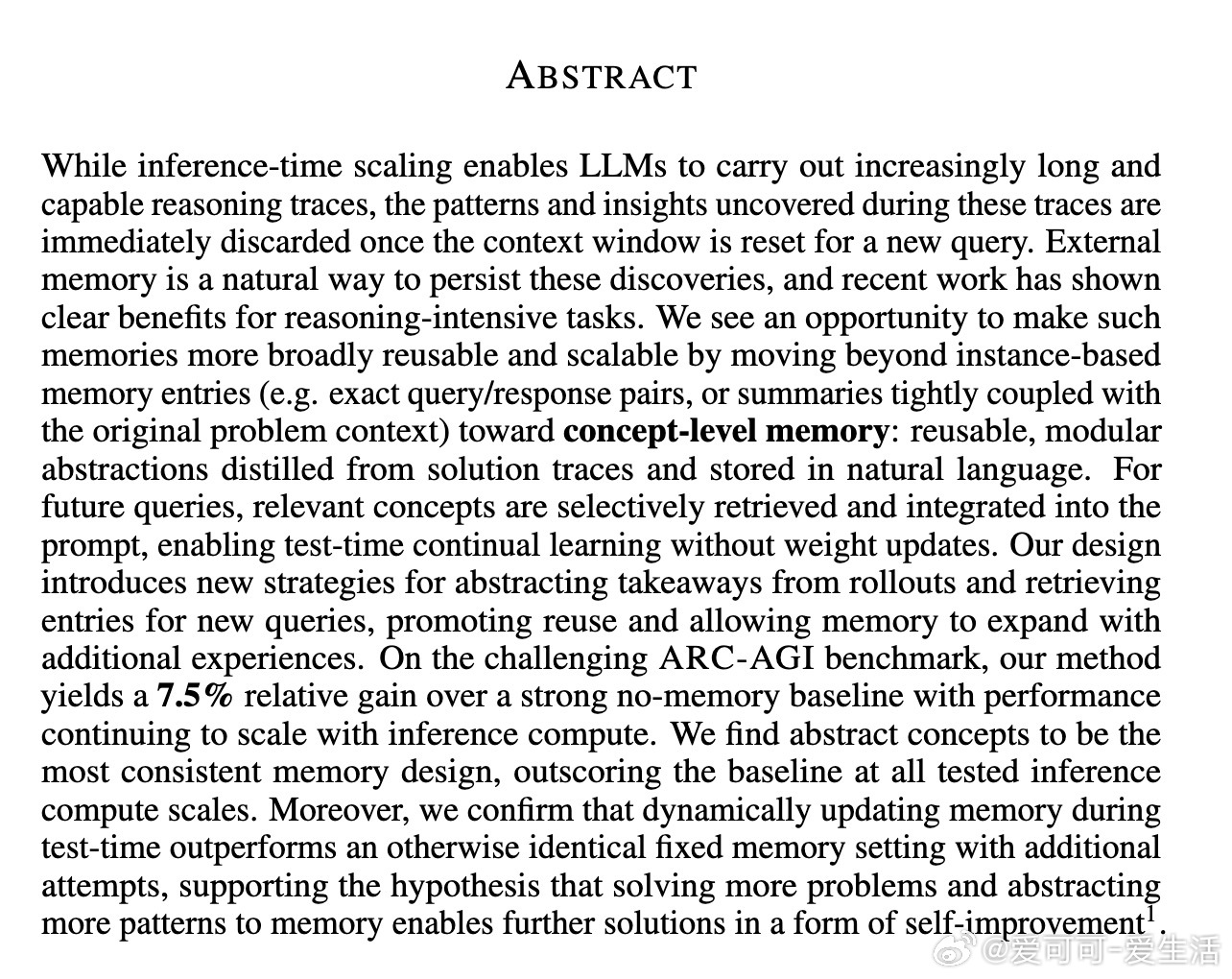

ArcMemo提出了一种面向推理密集型任务的抽象概念级记忆框架,突破了传统实例级记忆的局限,实现了LLM在测试时持续学习和自我提升。

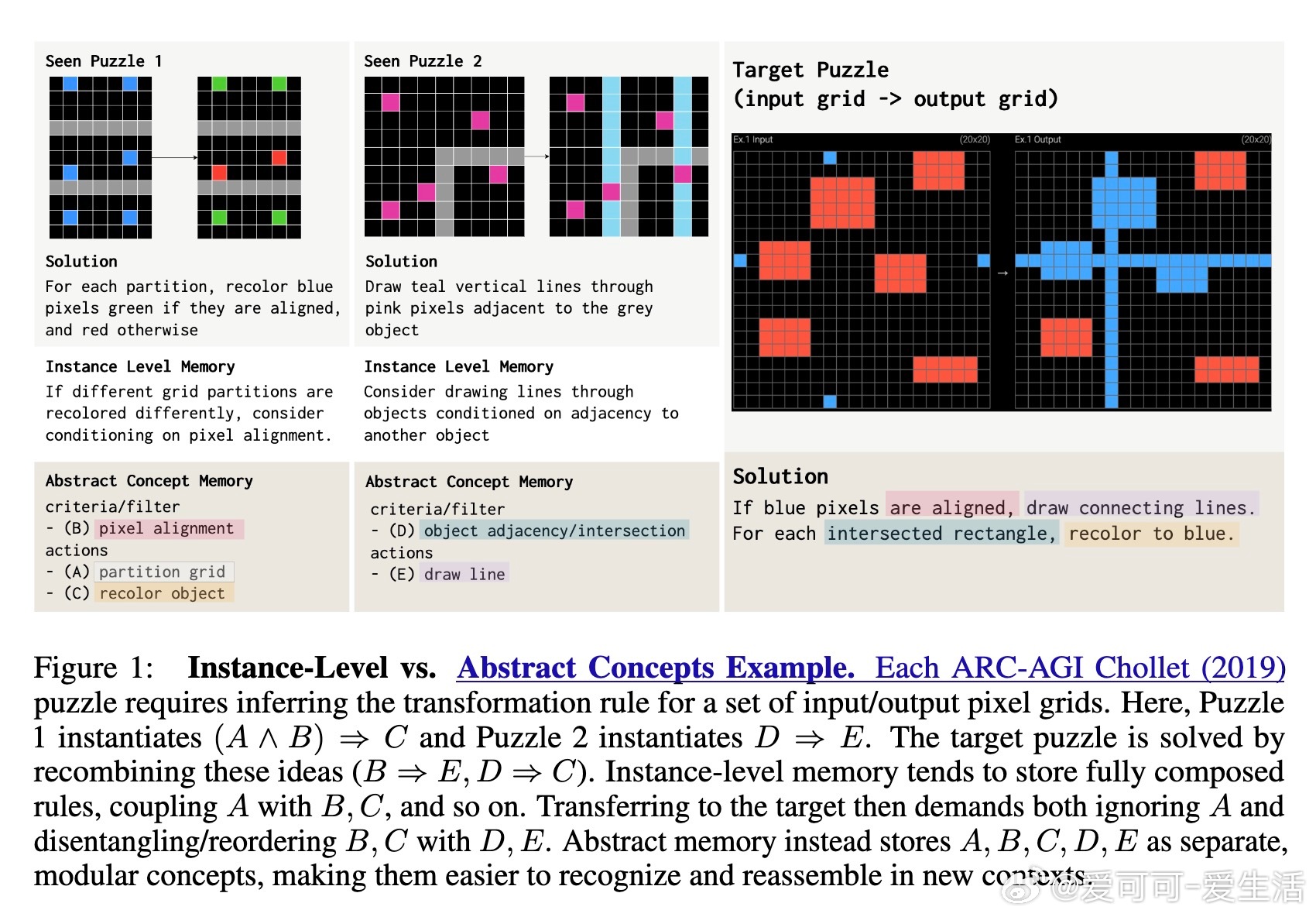

• 记忆存储抽象且模块化的概念,脱离特定问题背景,支持跨任务重组与复用,显著提升了记忆的泛化能力。

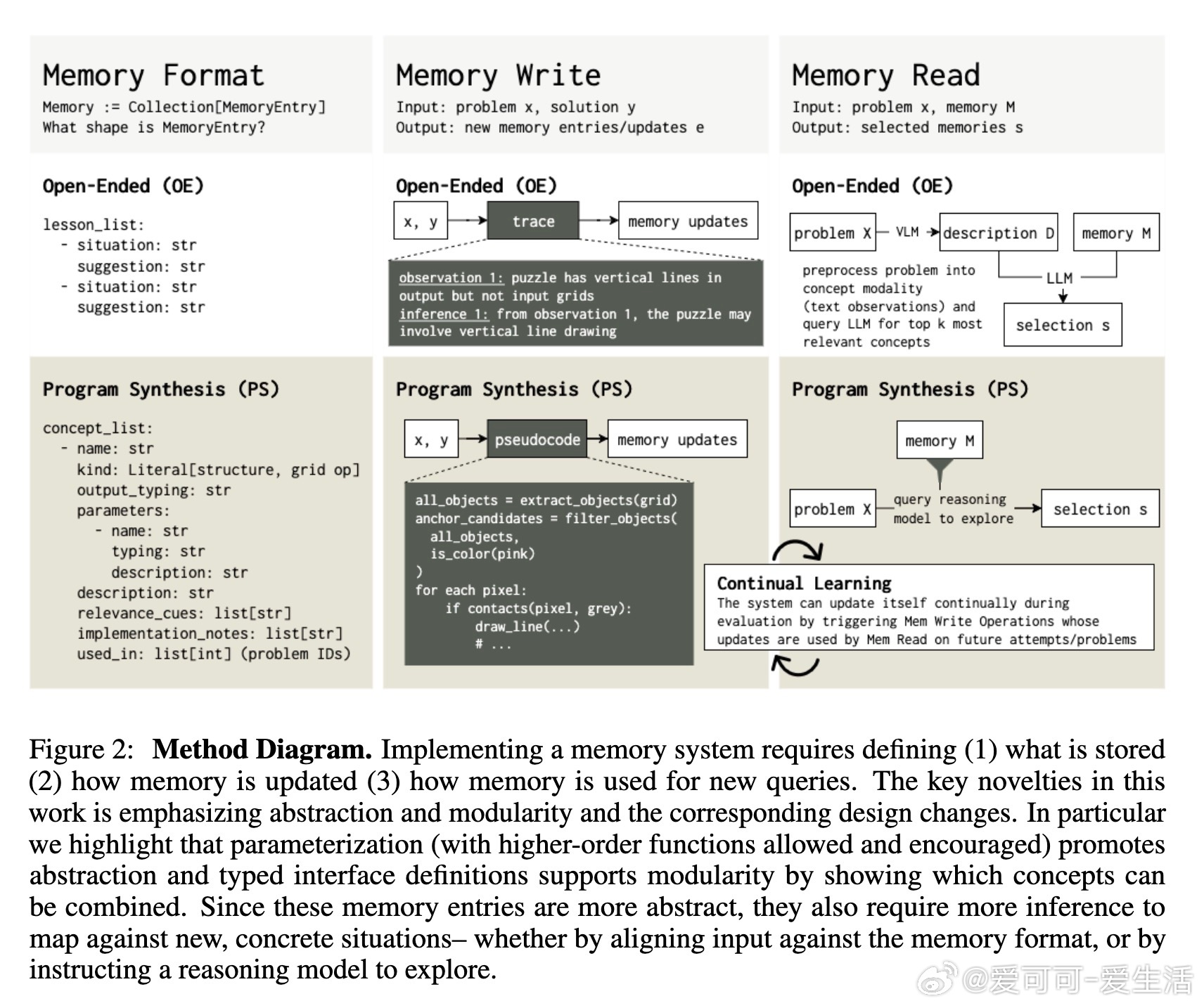

• 设计了两种记忆格式:开放式(OE)弱约束、程序合成式(PS)结构化,PS格式通过参数化和类型注解强化抽象与组合性。

• 记忆写入基于对解题过程的反思与抽象,利用少样本示范引导模型提炼高层次概念,PS格式支持对已有概念的动态修订。

• 记忆读取引入选择机制,有效筛选与当前问题最相关的概念条目,避免上下文窗口拥堵,PS选择采用系统2式的推理探索,提升匹配准确度。

• 支持测试时基于反馈的持续更新,实现无须权重调整的终身学习,解决了问题顺序敏感性和批处理带来的性能波动。

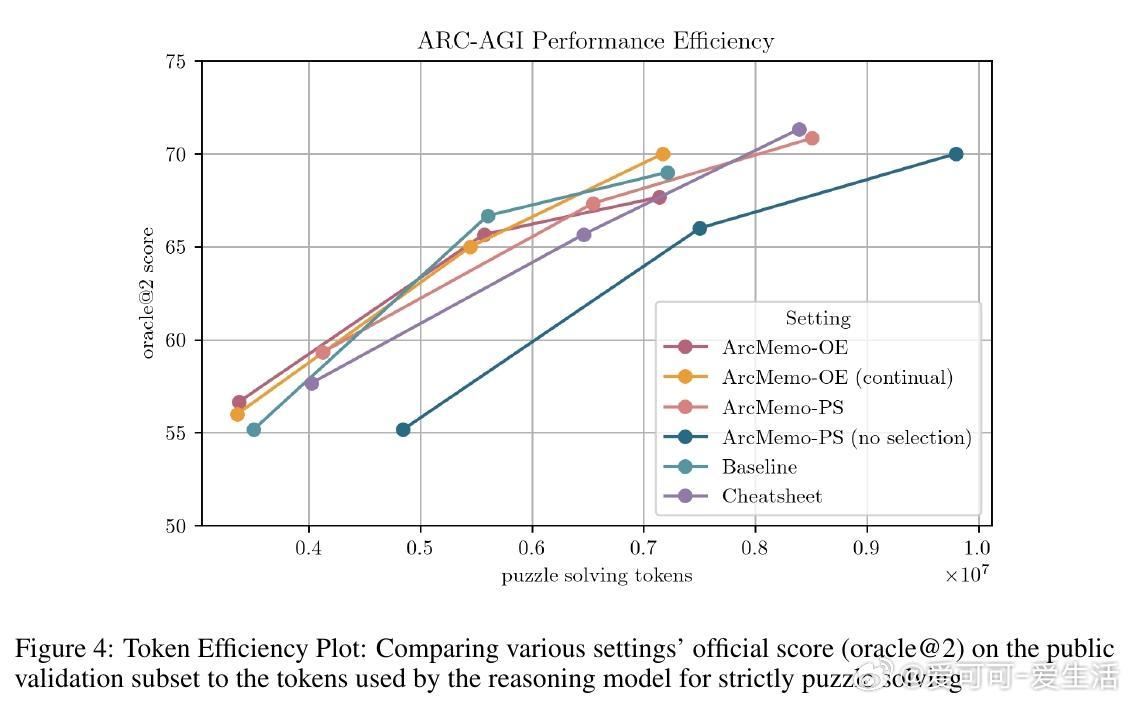

• 在ARC-AGI基准测试中,ArcMemo-PS相较强基线提升7.5%相对得分,且性能随推理计算规模持续提升,验证了抽象记忆设计的有效性。

• 选取子集记忆策略不仅节省tokens,也提升了推理效率和准确率,体现了记忆管理对长期扩展性的关键作用。

• 消融实验显示,缺失选择机制会导致性能下降且token消耗大幅增加,进一步确认了精细记忆筛选的重要性。

心得:

1. 将记忆设计从具体实例抽象至模块化概念极大增强了知识迁移与组合潜力,符合人类解决复杂问题时积累知识的方式。

2. 推理驱动的记忆选择机制优于传统嵌入相似度检索,体现了深度理解和系统思考在复杂认知任务中的必要性。

3. 测试时动态更新记忆并反馈促进了模型的自我完善,展示了无须训练即可实现持续学习和能力迭代的未来方向。

详见🔗arxiv.org/abs/2509.04439

人工智能大模型推理终身学习记忆增强程序合成