商悟社2月22日

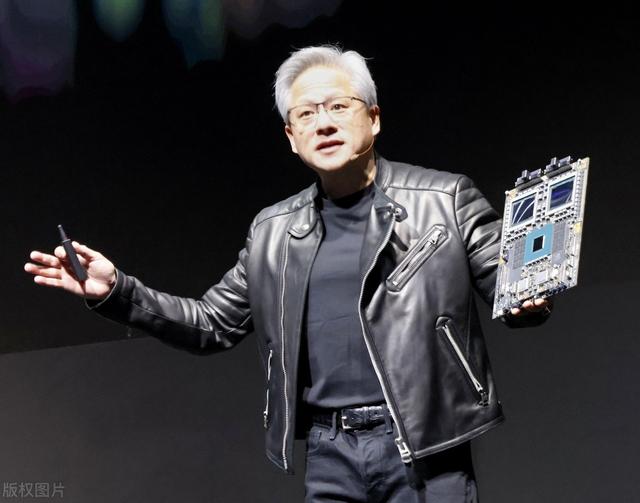

2025年1月,中国AI公司DeepSeek发布的R1开源模型如同一颗“核弹”,不仅以低成本高性能震动科技圈,更让美国芯片巨头英伟达单日市值蒸发5900亿美元,创下美股历史纪录。两个月后,英伟达CEO黄仁勋首次公开回应此事,直言:“投资者误解了AI的未来。”

“市场反应是错的”面对R1模型引发的算力需求质疑,黄仁勋在2月20日的访谈中态度鲜明:“AI远未到头,反而需要更多算力。”他解释,投资者误以为AI只需“预训练+简单推理”就能完成,但真正的核心在于“后训练”——即模型学会解决问题的过程。

“预训练是打基础,后训练才是真正的智能。”黄仁勋举例,就像学生掌握基础知识后,需要通过大量练习才能解题。而这类“练习”需要消耗海量算力,且随着推理复杂度提升,需求只会更高。

开源热潮下的算力真相DeepSeek R1的颠覆性在于:用2048块英伟达H800芯片、557万美元成本,训练出性能比肩OpenAI顶级闭源模型的成果

。这令市场担忧“算力军备竞赛”是否必要。但黄仁勋强调,R1的成功恰恰证明算力价值:“它开源后,全球开发者都在用我们的GPU做二次创新。”

事实佐证了他的观点:华为昇腾、AMD等平台适配R1时,性能损失最高达70%

,而英伟达芯片仍是效率首选。即便美国放宽对华芯片限制,中国科技公司仍持续采购英伟达产品。

行业暗战:开源倒逼巨头变革DeepSeek的冲击波远未结束。OpenAI紧急推出开源模型O3-mini,百度宣布文心大模型免费,阿里、谷歌等云厂商争相部署R1

。这场开源浪潮背后,黄仁勋却看到机遇:“R1点燃了全球AI开发者的热情,而这需要更多算力支持。”

截至发稿,英伟达股价已从118美元低点回升至135美元,但市场仍在等待2月26日的财报会议——黄仁勋能否用数据证明“算力需求增长”的故事,将成为下一个焦点。

中国GPU好像差的是制程和产量,只要这两样追上去,基本没有英伟达什么事了