AI换脸诈骗席卷全国!你的脸正在被陌生人"偷走"

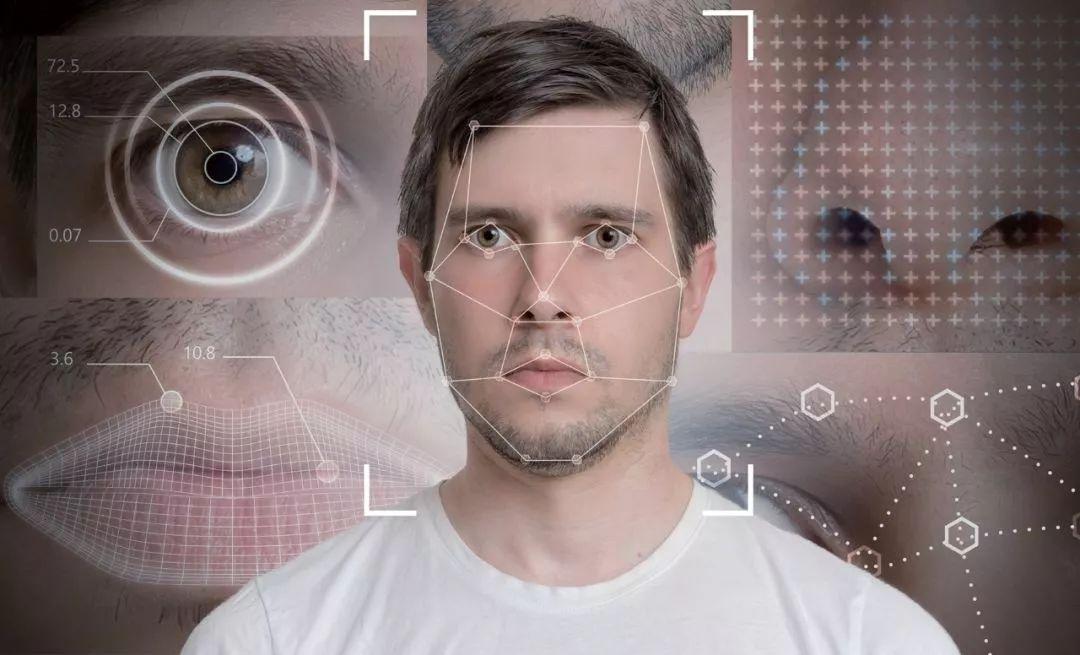

二、技术解构:深度伪造如何突破安全防线据腾讯安全实验室披露,当前AI换脸技术已迭代至DeepFaceLab 3.0版本,仅需3秒语音样本即可模拟声纹,面部表情动态捕捉误差率降至0.07%。诈骗分子通过非法获取的身份证照片、社交账号视频,结合开源算法工具包,可在普通笔记本电脑上生成以假乱真的实时视频通话。

三、黑色产业链:人脸数据的地下交易在某暗网交易平台,包含50组动态人脸数据的"料包"售价仅88元,支持定制化需求。这些数据主要来自三大泄露渠道:公共场所人脸识别设备、美颜软件后台数据库、网络平台实名认证信息。网络安全专家实测发现,在短视频平台点赞超过1000次的用户,其面部特征被建模成功率高达92%。

四、全民防御指南(重点必看)日常防护:视频通话时要求对方转头或遮挡部分面部,AI换脸系统难以处理侧脸光影变化。资金验证:建立"声纹+动态手势"双重确认机制,某银行试点该方案后成功拦截97.3%的换脸诈骗。信息保护:慎用"AI算命""面容测试"等小程序,国家网信办已下架138款涉嫌违规采集的应用。

结语:在这场人与技术的博弈中每一次视频通话的迟疑,每一条朋友圈视频的谨慎,都在重塑数字时代的生存法则。当我们不得不以"怀疑"作为防御武器时,或许更该思考:科技狂飙突进的今天,人类该如何守护那0.01%不可复制的真实?

(本文数据来源:公安部新闻发布会、国家网信办专项整治通报、腾讯安全年度报告)