“数字计划”(Project DIGITS)项目电脑可运行本地聊天机器人或其他参数量达 2000 亿的人工智能模型。

周一,英伟达宣布了 “数字计划” 项目,这是一款面向想要在家中试验人工智能模型(比如像 ChatGPT 这样的聊天机器人以及图像生成器)的研究人员、数据科学家和学生的小型桌面电脑。这款售价 3000 美元的设备搭载了英伟达新款 GB10 格蕾丝・布莱克韦尔超级芯片,在拉斯维加斯举办的 2025 年国际消费电子展(CES)上首次亮相。它将于 5 月上市,既可以作为独立的个人电脑运行,也能连接到 Windows 或 Mac 电脑上。

在周一的国际消费电子展上,英伟达首席执行官黄仁勋将这一新系统描述为 “放在你桌上的云计算平台”。该公司还将 “数字计划” 项目设计成桌面开发与云端部署之间的桥梁。开发者可以在 “数字计划” 项目设备上本地创建并测试人工智能应用程序,然后再将它们迁移到使用类似英伟达硬件的云服务或数据中心。

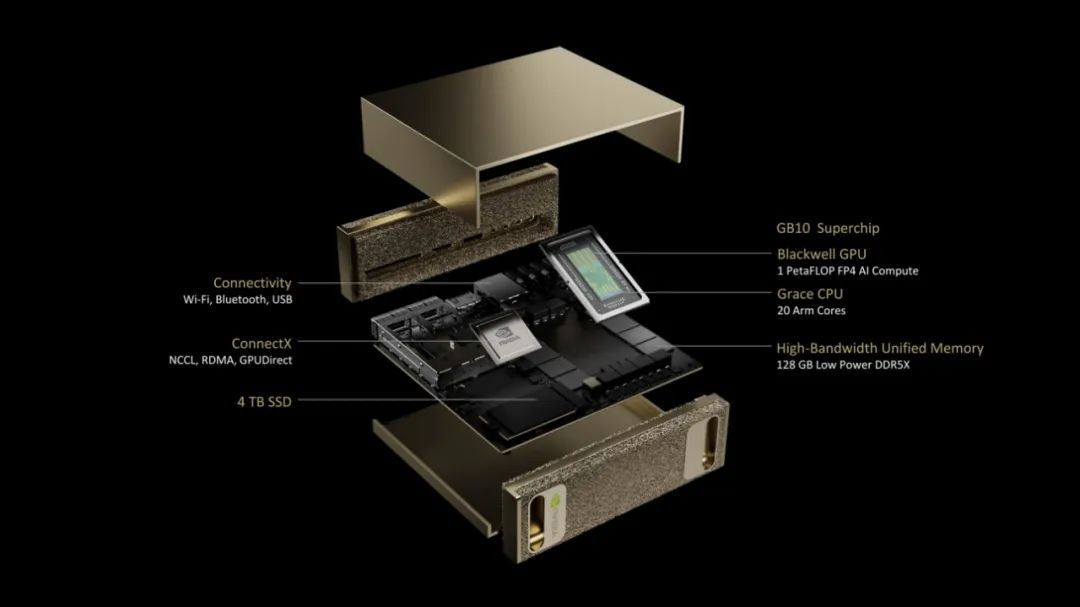

“数字计划” 项目电脑内部的 GB10 芯片将英伟达布莱克韦尔图形处理器(GPU)与基于 ARM 架构的 20 核格蕾丝中央处理器(CPU)相结合。英伟达与联发科合作研发了这款芯片,它能与 “数字计划” 项目机箱内的 128GB 内存以及最高 4TB 的存储设备相连。

本地运行人工智能模型

目前,由于计算要求,许多人使用的人工智能模型必须在远程数据中心运行。随着时间推移,人们一直在努力精简一些人工智能模型,以便它们能在本地个人拥有的硬件上有效运行。“数字计划” 项目能够在家中提供部分这样的能力。

据报道,一台 “数字计划” 项目设备可运行参数量最多达 2000 亿的人工智能模型,而两台相连的设备则能够处理参数量达 4050 亿的模型。在人工智能模型中,参数数量大致对应着人工智能模型神经网络的规模和复杂程度,参数越多,运行时所需的内存和计算能力就越高。此外,参数规模也近似体现人工智能模型的能力,不过不同规模的人工智能模型因其训练方式和架构不同,表现也会有所差异。

一些较小的开源权重人工智能语言模型(比如拥有 700 亿参数的 Llama 3.1 70B 模型)以及各类人工智能图像合成模型(如拥有 120 亿参数的 Flux.1 开发版模型)或许能在 “数字计划” 项目设备上顺畅运行,但像拥有 4050 亿参数的 Llama 3.1 405B 这样更大的开源模型可能就无法运行了。鉴于近期小型人工智能模型的大量涌现,富有创意的开发者很可能在该设备上运行不少有意思的模型。

“数字计划” 项目设备的 128GB 统一内存值得关注,因为像 RTX 4090 这样的高性能消费级图形处理器仅有 24GB 显存。内存对人工智能模型的参数规模起着硬性限制作用,更多的内存为运行更大的本地人工智能模型提供了空间。

该系统运行在英伟达基于 Linux 的 DGX OS 操作系统上,并包含对英伟达人工智能软件工具的访问权限,比如 NeMo 框架(有助于人工智能模型开发)以及 RAPIDS 库(开发者用于创建人工智能应用程序)。用户还可以运行常见的人工智能开发工具,如 PyTorch、Python 和 Jupyter 笔记本。

“数字计划” 项目与其他本地人工智能设备相比如何呢?英伟达表示,其新款电脑起售价为 3000 美元,这意味着一台配置拉满的设备成本可能会高得多。在 10 月的一份新闻稿中,苹果公司写道,搭载 M4 Max 芯片的 Mac 电脑最高可配备 128GB 统一内存,并且有可能运行参数量达 2000 亿的人工智能模型,这与 “数字计划” 项目电脑类似。

目前,一台搭载 M4 Max 芯片且配备 128GB 统一内存的 MacBook Pro 在美国的售价约为 4699 美元,这使得 “数字计划” 项目在价格和人工智能能力方面可能具有可比性,不过二者在人工智能性能方面的真正差异还得通过实验室测试才能知晓。