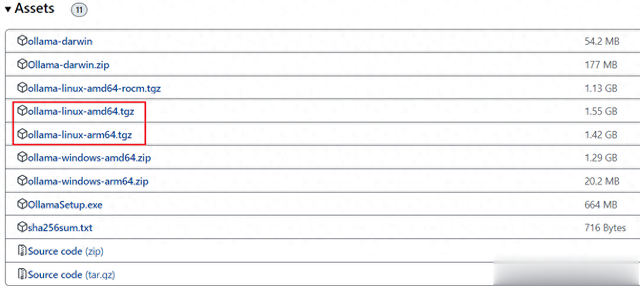

安装和运行在有网络的环境下载好tgz安装包,并上传到离线 Linux 服务器安装,使用下面的命令:sudo tar -C /usr -xzf ollama-linux-amd64.tgz启动 Ollama,使用下面的命令:ollama serve另外启动一个终端验证是否运行成功,使用下面的命令:ollama list

安装和运行在有网络的环境下载好tgz安装包,并上传到离线 Linux 服务器安装,使用下面的命令:sudo tar -C /usr -xzf ollama-linux-amd64.tgz启动 Ollama,使用下面的命令:ollama serve另外启动一个终端验证是否运行成功,使用下面的命令:ollama list这样 Ollama 就算安装完成了。之所以下载 Ollama,是因为 Ollama 提供了大模型运行的所有环境,使用它能方便的在本地运行各种 LLM。

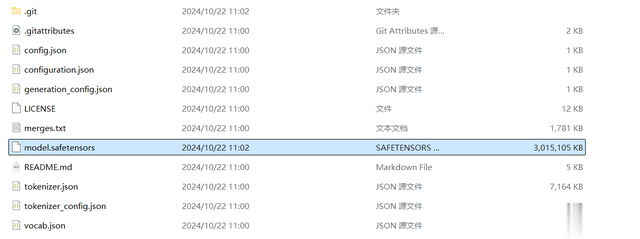

在 Ollama 上部署 Qwen2.5下载 Qwen2.5在国内 AI 社区 ModelScope 下载 Qwen2.5 模型,国外的 AI 社区 Hugging Face 也可以下载,不过要想下载国外的大模型,例如 Llama,需要填写联系信息进行申请,不过申请了也不一定会给过的。 推荐使用 Git 下载,使用下面的命令:git lfs installgit clone https://www.modelscope.cn/Qwen/Qwen2.5-1.5B-Instruct.git从 Safetensors 导入模型Git 克隆下来的仓库会包含一个 model.safetensors 文件,需要将其格式转换为二进制 .bin 形式,才能由 Ollama 着手导入进行管理。

推荐使用 Git 下载,使用下面的命令:git lfs installgit clone https://www.modelscope.cn/Qwen/Qwen2.5-1.5B-Instruct.git从 Safetensors 导入模型Git 克隆下来的仓库会包含一个 model.safetensors 文件,需要将其格式转换为二进制 .bin 形式,才能由 Ollama 着手导入进行管理。 大模型格式转换主要用到一个工具 llama.cpp,使用下面的命令同步 llm/llama.cpp 子模块:git clone [git@github.com](mailto:git@github.com):ollama/ollama.git ollamacd ollamagit submodule initgit submodule update llm/llama.cpppython3 -m venv llm/llama.cpp/.venvsource llm/llama.cpp/.venv/bin/activatepip install -r llm/llama.cpp/requirements.txt转换模型Qwen2.5,使用下面的命令:python llm/llama.cpp/convert_hf_to_gguf.py ./model --outtype f16 --outfile converted.bin编写模型文件 Modelfile (没有后缀名),文件内容如下:FROM converted.binTEMPLATE """{{ if .System }}<|im_start|>system{{ .System }}<|im_end|>{{ end }}{{ if .Prompt }}<|im_start|>user{{ .Prompt }}<|im_end|>{{ end }}<|im_start|>assistant"""SYSTEM """你是一个乐于助人的助手,但你会用20世纪30年代黑手党暴徒的风格去回答问题"""将转换后的 .bin 文件和 Modelfile 文件上传到离线的 Linux 服务器的同一目录下,使用下面的命令导入到 Ollama:ollama create Qwen2.5 -f Modelfile查看和运行大模型,使用下面的命令:ollama show Qwen2.5ollama listollama run Qwen2.5ollama ps

大模型格式转换主要用到一个工具 llama.cpp,使用下面的命令同步 llm/llama.cpp 子模块:git clone [git@github.com](mailto:git@github.com):ollama/ollama.git ollamacd ollamagit submodule initgit submodule update llm/llama.cpppython3 -m venv llm/llama.cpp/.venvsource llm/llama.cpp/.venv/bin/activatepip install -r llm/llama.cpp/requirements.txt转换模型Qwen2.5,使用下面的命令:python llm/llama.cpp/convert_hf_to_gguf.py ./model --outtype f16 --outfile converted.bin编写模型文件 Modelfile (没有后缀名),文件内容如下:FROM converted.binTEMPLATE """{{ if .System }}<|im_start|>system{{ .System }}<|im_end|>{{ end }}{{ if .Prompt }}<|im_start|>user{{ .Prompt }}<|im_end|>{{ end }}<|im_start|>assistant"""SYSTEM """你是一个乐于助人的助手,但你会用20世纪30年代黑手党暴徒的风格去回答问题"""将转换后的 .bin 文件和 Modelfile 文件上传到离线的 Linux 服务器的同一目录下,使用下面的命令导入到 Ollama:ollama create Qwen2.5 -f Modelfile查看和运行大模型,使用下面的命令:ollama show Qwen2.5ollama listollama run Qwen2.5ollama ps这样 Qwen2.5 就算导入成功了,实际上 llama 工具还可对大模型进行量化,量化后的大模型会更加精确,更加节省系统资源,有关量化的信息可自行研究。

分类: AI / LLM