最像人声的AI来了!语音开源天花板ChatTTS火速出圈,3天就斩获9k个star。

截至发稿前,已经20.3k个star了。这是专门为对话场景设计的语音生成模型,用于LLM助手对话任务、对话语音、视频介绍等,仅支持中英文。(项目地址:https://github.com/2noise/ChatTTS)

从宣传视频以及其他爱好者的试用情况来看,4w小时训练的版本效果已经非常不错了,生成语音的效果真假难辨,还会自动加入“emm……”“然后”等语气词,韵律和情感逻辑的效果吊打Google TTS,要说一句“同比最强”毫不夸张。

强者可能也承受着更挑剔的目光,以列文虎克般的眼光,我也发现了ChatTTS有待改进的稳定性、生成速度等问题,这也让人萌生了一丝期待。

/ 01 / 实测:韵律和情感逻辑超能打,基本错误也挺多

ChatTTS可以本地部署,官网也提供了在线合成语音试用的地址(http://www.chattts.com),我们就在线试用版本来和大家分享一下体验感受。

TTS全写是Text To Speech,即文本转语音,我们在ChatTTS网页的文本框输入一段文字,随机抽选音色,并使用IPython.display库中的Audio函数来播放生成的音频,音频可保存为WAV文件。

▲测试语音“从油管、B站的众多视频博主以及我自己的试用情况来看……”

颇有趣味的是,抽卡过程像是开盲盒一样,从预训练的说话者模型中随机选择一个说话者,不知道是会开出“天津大爷”还是“严肃的女教师”。而同一段文本,同一个音色卡,多轮生成的结果都是不一样的,这增加了模型的可玩性。

▲ChatTTS的音色抽卡

比较几次生成的语音,我发现生成速度实在是有点慢,一段50字的文本AI生成语音约用时18s,如果是长文本,那用时也是等比增加的。另外,这个4w小时训练的版本生成的语音音质比较差,句头有明显的杂音、重读。看来,想直接把这么强的AI模型生成的音频直接拿去用,还不行。

如果提供的文本中有数字、英文,模型推理越来越容易产生问题,比如读不对、吞字之类的,像是“ChatTTS”中的“TTS”,模型根本读不出来。

然而这些气口加得有点猛,在归音的地方有气口显得并不适宜;有多个语气词的时候,比如“你干嘛,哼哼哎呦”这句,ChatTTS生成语音展现的情感也比较割裂!这也是模型在情感逻辑表现上的双面性。

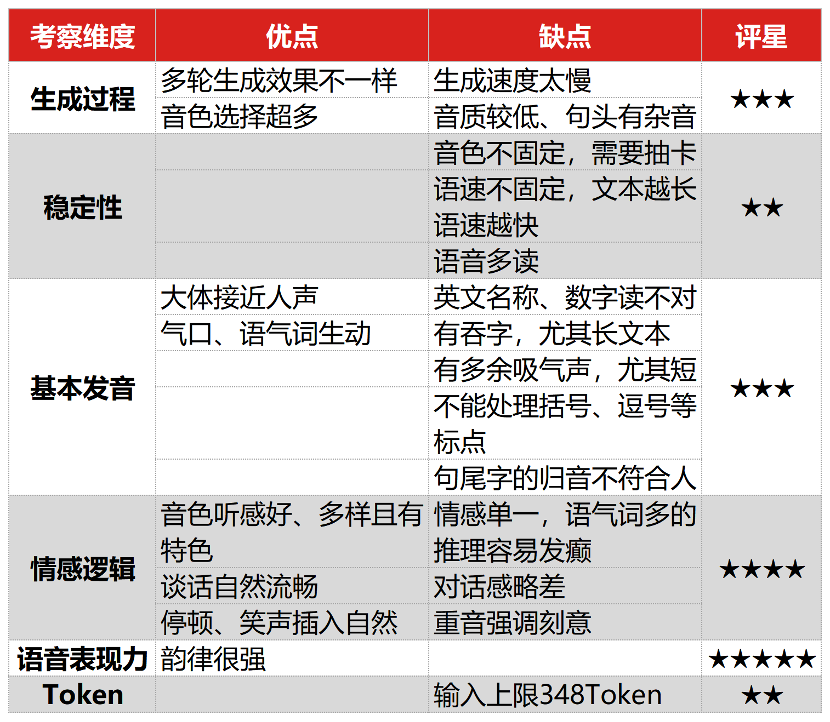

总的来看,ChatTTS最具杀手优势的便是韵律表现力和情感逻辑了。而模型在细粒度控制上生动但有赘余,存在着两面性。此外,稳定性在固定音色、固定语速等方面有很大的提升空间,基本发音很容易出现各种各样的错误。我的总结和各维度的评星如下:

▲在线版本试用总结

据了解,ChatTTS主要是从细粒度和韵律上寻求突破升级。如果用上本地部署版本,该模型能够预测和控制细粒度的韵律特征,包括笑声、停顿和插入词等,我们还可以在文本中加入 [laugh] 和 [uv_break]之类的“笑果”,来增加生动感。

/ 02 / “4w小时版本够好了”,预计推出“对话”版本

ChatTTS模型经过超过10w小时的训练,并在B站上展示,在HuggingFace上提供了一个4w小时预训练的公开版本模型。从这个10w小时版本的视频中,还是能看出,TTS普遍存在的数据缺失情况,ChatTTS并没有解决,于是出现了不能处理括号和逗号等标点、吞字等情况,因此后续还需要关键词助手。

不过,满血状态的10w小时版本的模型是不开源的。“4w小时的版本效果已经很好,只是网络小一些,稳定性差一些。”创作团队2Noise表示,他们保留了10w小时训练数据的版本模型。

后续工作,他们将继续从4w小时版本的底模开始,保证生成的语音能被开源的安全模型或Resemble.AI等语音生成工具检测出来,将工作重心放在高可控、水印以及与LLM的对接上。同时,2Noise在内部训练了检测模型,并计划在未来开放。

▲2Noise表示仅开源4w小时的底模,并预告了“对话”模型(来源:X)

对于2Noise来说,后续除了需要对模型改善音质、气口和停顿外,还可以在音色克隆上有更多尝试,以满足AI游戏陪聊、AI语音电话、AI配音生成、AI明星伴侣、AI克隆等多种场景。2Noise称,目前支持音色克隆,但需要更大的数据量。

瑕不掩瑜,ChatTTS在韵律方面超越了大部分开源TTS模型,这一点是显而易见的。这个最像人声的AI项目让我兴奋起来,一键关注并star!后续会关注一下项目的稳定性、推理速度、训练难易度和训练用的数据集。

/ 03 / 以防用户犯罪?压低音质、掺入明显错误

有一个问题是不能忽略的,ChatTTS开源的4w小时版本模型音质很低,包括在话头掺入了杂音。

2Noise团队对这个声音深度伪造的问题表现出谨慎的态度,团队称为了限制ChatTTS的使用,在4w小时模型的训练过程中添加了少量额外的高频噪音,并用mp3格式尽可能压低了音质,以防不法分子用于潜在的犯罪可能。

这逻辑好似在煤气里加入难闻气味的气体,以预警人们注意。

10w小时版本模型的表现让看客心痒,2Noise却表示暂时不会公开该版本10w小时的版本。10w小时训练的ChatTTS模型使用了大量的互联网数据,并进行了监督微调(SFT),在法律上有一定的风险。

▲官方在B站展示视频下的置顶评论

诚然,AI语音合成软件总是伴随着深度伪造的争议。不论是寂寂无名的配音演员,还是赫赫有名的明星,都有可能在互联网环境里被擅自拿取声音用作train。

例如,著名演员“寡妇姐”Scarlett Johansson曾拒绝Sam Altman请她配音的请求,而OpenAI为GPT-4o创造了一个与她极其相似的声音“Sky”。Scarlett在上月末向OpenAI发送律师函后,Open AI才关闭了Sky的语音使用。

一轮又一轮的融资仍佐证了资本市场对AI语音产业的看好。例如2024年1月,ElevenLabs跻身独角兽,该公司从估值1亿美元到估值10亿美元,也只过去了半年时间。ChatTTS引发巨量的讨论,足以见得人们对于表现亮眼的AI语音产品充满了好奇与期待,让我们继续关注ChatTTS在技术与商业化上的进展。