有一天,你在社交媒体上刷到了一段视频,威尔·史密斯在视频中津津有味地吃着意面。

这是一个极为普通的场景,但如果我告诉你,这个视频不是简单地拍摄,而是通过AI技术生成的,你会不会感到惊讶甚至有些困惑?

事情就是这样发生的。

上个月,威尔·史密斯的这段意面视频在网上引起了轩然大波。

最初,大家都以为这就是一个普通的视频,但事实是,它实际上由AI技术生成,而不是威尔·史密斯亲自拍摄。

这个消息一经曝光,立即在社交媒体上引发了大量讨论。

这个看似简单的视频,背后隐藏着巨大的技术突破,更是让人们对AI技术有了新的认识。

其实,这场关于AI视频的“骗局”并非从今天才开始。

早在今年1月,就有行业专家预言了这种技术发展的可能性。

今年初,一位来自阿里的AI专家就提出,Transformer框架和大型语言模型(LLM)路线,将会是AI视频制作的一个突破口。

他们认为,这种路线能够使AI视频更加连贯、一致,甚至在时长上也更有优势。

这一时间点上,不只是一个人想到这个方向。

斯坦福大学的李飞飞教授早在去年就已经用Transformer做出了逼真的视频效果。

随着时间的推进,这一技术不断发展和完善,最终由OpenAI的Sora项目将其大力推进,成为今天我们所看到的逼真视频。

那是什么让Sora如此特别?

为什么它能够做到如此逼真的效果?

关键就在于它使用了Transformer框架。

传统的AI视频生成,大多基于图像延伸和填补的方法,这些方法虽然能够完成基本的视频生成,但往往在一致性上存在问题,导致视频容易出现变形或不自然的现象。

Sora的不同之处在于它秉承了Transformer对前后文高效的理解和强大的一致性。

这种方法不仅仅是对当前帧的生成,更是对整个视频的逻辑和连贯性进行考量。

简而言之,Sora能够提前为视频写好“脚本”,确保每一帧图像都是顺畅且符合逻辑的。

这一方法,使得Sora在无缝生成逼真视频方面表现得尤为出色。

OpenAI为什么总能率先取得突破?

在AI领域,OpenAI确实有着独特的优势。

他们不仅有强大的技术团队,还有充足的资金支持。

大量的资金投入使得OpenAI在数据和算力上都具备压倒性优势,使其能够不断探索和实验AI技术的新可能性。

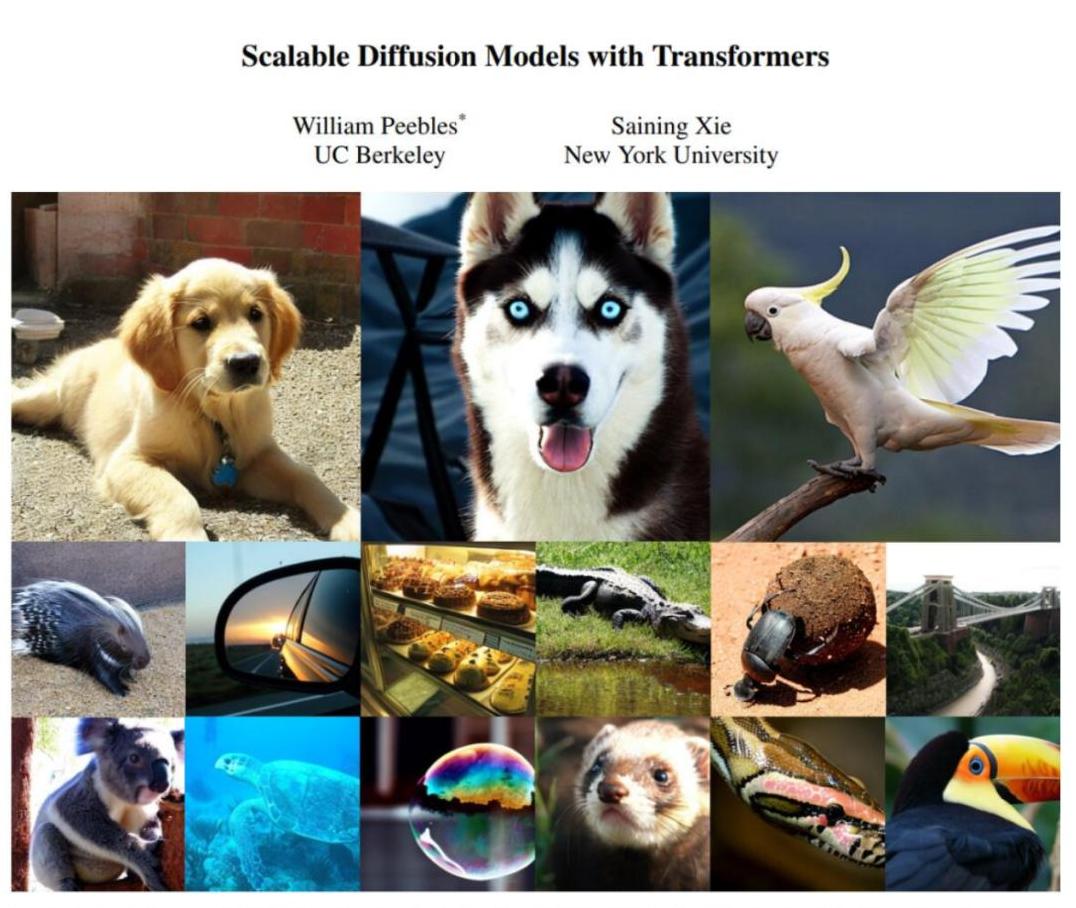

这一次,OpenAI将Transformer和Diffusion Model的结合运用到了极致,将之前的散点式技术树集中到了一起来攻克实际难题。

这样的技术路线不仅带来了效果上的突破,也开创了一种全新的AI视频生成范式。

威尔·史密斯吃意面的视频,最终不仅让我们看到了AI技术的强大能力,也引发了我们对未来技术应用的更多思考。

AI技术的发展离不开前人的研究和探索,更需要不断的创新和实践。

正如站在巨人的肩膀上,我们需要有更高的视野和更清晰的目标。

AI技术仍在飞速发展,每一步突破都带来无限可能。

也许,未来你看到的每一个视频,都可能不是传统拍摄而成,而是由AI生成的。

我们需要用开放的心态迎接这样一个充满可能性的时代,期待更多技术奇迹的到来。

在这条充满未知的探索路上,我们需要做的,就是保持好奇心和对未来的期待,让科技真正服务于人类的美好生活。

正如那段威尔·史密斯的意面视频,它不仅是AI技术的一次展示,更是对未来生活的一个大胆预言。

希望我们都能一起见证这样的未来,在不断变化的世界里发现更多奇迹和可能。