前言:随着科技的飞速发展,人工智能技术已经不单单是传统的认知了,而且也给“眼见为实”重新定义了新的概念。

如今我们肉眼所见的视频、耳中所闻的语音,都可能经由AI技术伪造,几乎可以做到以假乱真,这并非危言耸谈,而是正在发生的现实威胁。

那么如果AI技术被不法分子滥用,那么便会演变成一种种新型诈骗手段,而且精准打击,威胁着我们个人的合法权益。

这也让我们必须认识到,AI时代,眼见不再一定为实,那么新型骗局又有哪些呢?我们又该如何避免呢?

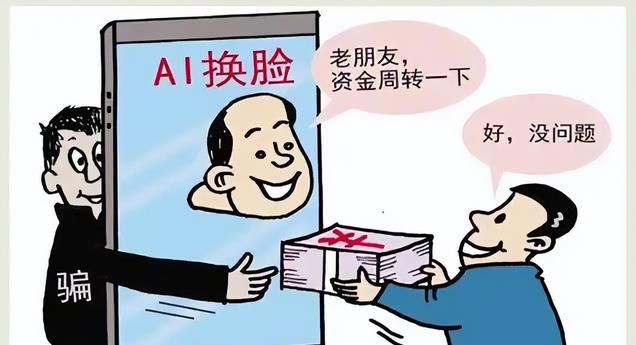

AI换脸诈骗

现在的AI换脸技术,随着技术的提升,已经能够将一个人的面容天衣无缝的替换到另外一个人的身上,而且视频通话几乎很难分辨真伪,想象一下,这种技术一旦落入不法分子手中,那么将成为实施诈骗的利器。

之前身在福州的郭先生就遇到过这样的事情,他先是接到一位“好友”的微信视频电话,对方声称自己在外地竞标,手中急需430万元保证金,而且需要通过郭先生的公司账户进行转账。

由于毕竟是视频通话,而且对方与自己好友的容貌、声音完全一致,这也让郭先生放下了戒备,将430万元转入了对方的账户。

文章信源:警惕“AI”!这种诈骗成功率近100%——光明网

事后,回想起来,这时的郭先生才意识到,自己掉入了一个精心设计的陷阱之中,而那位所谓的“好友”只不过是AI技术合成的虚拟人物,而且郭先生的经历并非个例。

还有一位受害者在浏览短视频的时候,收到了一个自称是他“表哥”的好友申请,通过之后,对方立刻打过来了电话,声称自己在非洲工作,由于当地信号不好无法转账,需要受害者进行转账垫付一下资金,并承诺事后会归还。

由于是亲戚关系,受害人并没有多想,便将15000元转了过去,可结果这笔钱最终石沉大海,这时受害人也意识到了自己是被AI技术合成的“表哥”欺骗了。

更令人担忧的是,AI换脸诈骗不仅能伪装成亲朋好友,还能伪装成公司领导、政府官员等,进一步增强迷惑性,李先生就遭遇了这样一场骗局。

一位自称是他公司领导的人加了他的私人联系方式,并提出借款请求,为了打消李先生的疑虑,“领导”主动发起视频通话,视频中的“领导”与真人无异,让李先生彻底放松了警惕,最终被骗走了95万元。万幸的是,警方迅速介入,成功追回了83万元。

这些案例揭示了AI换脸诈骗的可怕之处,不法分子利用AI技术对受害人的亲朋好友,以及工作上的同事领导,进行诈骗,但是由于高度逼真的AI合成技术,使不少人分辨不出,从而落入诈骗的陷阱。

尤其对于视力和听力下降的老年人来说,AI合成的声音和图像更具迷惑性,他们往往难以分辨真假,更容易成为诈骗分子的目标。

而AI换脸技术的核心在于其能够快速合成人脸和声音,并将其与视频无缝融合,达到以假乱真的效果,这种技术的出现,原本是为了推动科技进步,方便人们的生活,可没想到,在不法分子手中,却变成了实施诈骗的工具。

其他新型诈骗手段

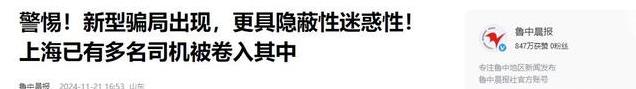

除了AI换脸诈骗,不法分子还在不断“创新”,开发出各种令人防不胜防的新型骗局,其中利用网约车司机充当“帮凶”的骗局,就展现了诈骗手段的狡猾与隐蔽。

而这些诈骗方式,诈骗分子会通过网约车平台下单,将骗取的财物,通过网约车司机送到指定地点,而不明真相的网约车司机,往往会将此视为普通的送货订单,欣然接受。

文章信源:警惕!新型骗局出现,更具隐蔽性迷惑性!上海已有多名司机被卷入其中——鲁中晨报

当司机到达指定地点后,会发现乘客并不上车,只是将一个箱子放到后座,并提供联系方式,让司机将物品送至另一个地点,毕竟送东西,也不会引起司机的怀疑,毕竟按照指定地点送货就行了。

可是司机不知道的是,自己已经无意间成为了诈骗分子的“帮凶”,成为了帮助他们转移赃物的中间人。

事后,司机往往会接到警方的询问,才恍然大悟,自己被卷入了一场精心策划的骗局,这种利用网约车“闪送”的骗局,不仅增加了警方的破案难度,也让网约车司机成为了受害者。

而老年人由于缺乏对新型诈骗手段的了解,更容易上当受骗,除此之外,还有不法分子,冒充网信办的工作人员进行诈骗,他们会以“协助调查”为理由,要求受害人通过电话或者其他途径与外地的“公安部门”取得联系。

文章信源:冒充“北京网信办”的诈骗电话又来了!勿听、勿信!——新京报

随后他们会对受害人进行一系列的恐吓,例如警告不配合调查将会面临严重后果,甚至使用伪造的拘捕令来恐吓受害人,以获取受害人的信任,在取得信任后,他们便会要求受害人提供身份证号、银行卡等信息,从而实施诈骗。

面对这么多新型诈骗方式,我们又该如何避免上当受骗呢?

如何识别和防范AI诈骗

随着AI技术的发展,识别和防范AI诈骗已经成为了现如今必备的生存技能,我们必须打破“眼见为实”的固有思维,时刻保持警惕,才能有效抵御日益猖獗的AI诈骗。

当接到亲友的借款请求,尤其是通过视频通话提出的请求时,我们不能轻信一面之词,应该通过其他联系方式进行验证,例如拨打电话、发送短信、使用其他社交软件,最好还是当面确认为好。

毕竟现在AI技术这么发达,尽管对方能够视频通话,也不能排除对方是否使用了AI换脸技术,只有多方验证才能确保自己不会被骗。

同时我们在视频中还需要观察视频中的细节,AI换脸技术虽然先进,但是并不是天衣无缝,我们可以留意视频中人物的一些生物特征,例如眨眼频率、嘴部运动、面部表情是否自然流畅等。

一旦发现这些特征与真人存在不少差异,或者出现不协调或者不自然的情况,那么就要提高警惕了,对方很有可能使用了AI换脸技术,除此之外,还可以要求对方进行一些大幅度动作来分辨。

除此之外,不管在任何时候,我们都应该谨慎对待任何转账交易行为,不要轻易点开不明链接,不要贪图小便宜,不要随意透漏个人信息,包括身份证号和银行卡号等等。

要牢记“天上不会掉馅饼”的道理,对于任何看似天上掉馅饼的好事,都要保持怀疑的态度,多方求证,避免落入骗子的圈套。

除了个人需要的注意的,我们也应该多关注公安机关和新闻媒体发布的防诈骗信息,通过了解诈骗手段,来提升自身的防范意识和能力。

文章信源:调查|不法分子盯上老年人,“AI换脸换声”难以辨别——京报网

结语

AI技术可以说是有好有坏,在日常生活中确实可以给我们带来便利,但是一旦被不法分子利用,那么将是一个危害我们权益的存在。

随着AI诈骗的出现,我们要时时刻刻提高自身的安全意识,加强防范措施,保护自己的财产安全。

在AI时代,防范诈骗已不再是简单的“小心谨慎”,而需要我们掌握新的知识和技能,了解AI技术的运作原理,识别AI诈骗的各种伪装,这样才能保护我们自身的权益。