在一个周六的下午,李明坐在咖啡店的角落里,皱着眉头盯着电脑屏幕。

他正在研究一个让他困惑已久的问题:为什么有些公司在短短几年内就能利用人工智能技术取得巨大成功,而自己的项目却一直没能突破瓶颈?

不知不觉间,他的注意力被桌上的咖啡杯吸引,杯子上印着一句话:“有时,答案就藏在看不见的地方。

”

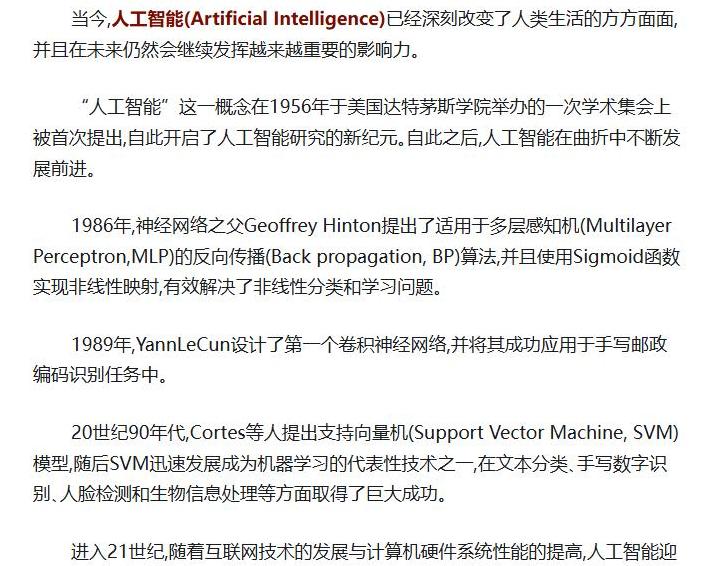

人工智能的演进和变革当李明开始深入了解AI时,他惊讶地发现,人工智能并不是一夜之间出现的奇迹,而是经过几十年的发展才有了今天的样子。

最初,它只是计算机科学家们在实验室里的一个个模型——一些对人类思维方式的简单模拟。

20世纪五六十年代,AI萌芽于少数实验室,它启发了一代又一代科学家不断追求真正智能的计算机。

慢慢地,随着计算能力的提升,尤其是20世纪80年代以来,AI开始从理论走向应用。

那些昔日看似科幻的想法一步步实现,像语音识别、图像处理,甚至是下棋战胜人类冠军的壮举,都让大众看在眼里。

李明意识到,和许多技术一样,AI的发展并非是一场孤立的革命,而是科技进步与社会需求相互交织的结果。

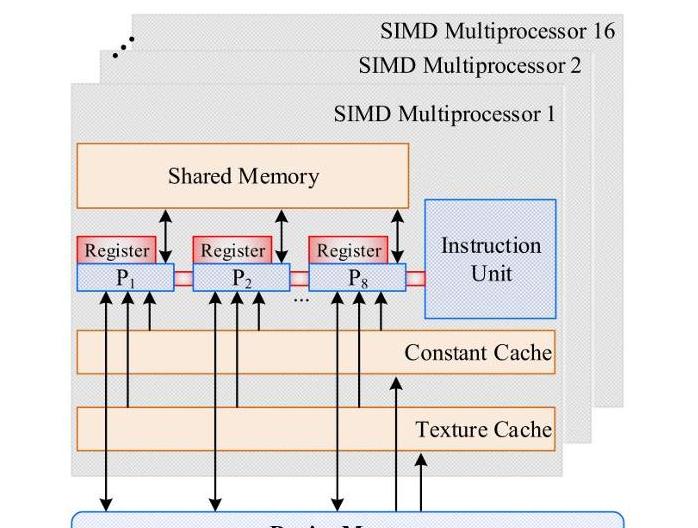

GPU在AI中的关键作用

李明决定再深挖下去,特别关注那句“答案藏在看不见的地方”,或者说,很多成功的企业,之所以能在AI领域大展拳脚,离不开一种关键的工具:GPU。

起初,GPU(图形处理器)只是用来处理图形的,加速我们在游戏中看到的逼真画面。

它在处理图像时展现出的强大并行计算能力,使其得以在AI领域大显身手,尤其是在深度学习中。

李明了解到,训练一个深度神经网络,需要进行大量的矩阵运算,而GPU的并行计算架构正好与这种需求相匹配。

在他的研究中,李明发现了一些具体案例:例如一家初创公司,凭借利用GPU加速深度学习模型,大幅提升图像识别的速度和准确度。

这并不是运气,而是对底层技术的深刻理解。

GPU的出现,降低了AI运算的时间成本,使得许多构想得以实现。

而正是这些不起眼的硬件革新,推动了AI应用的广泛普及。

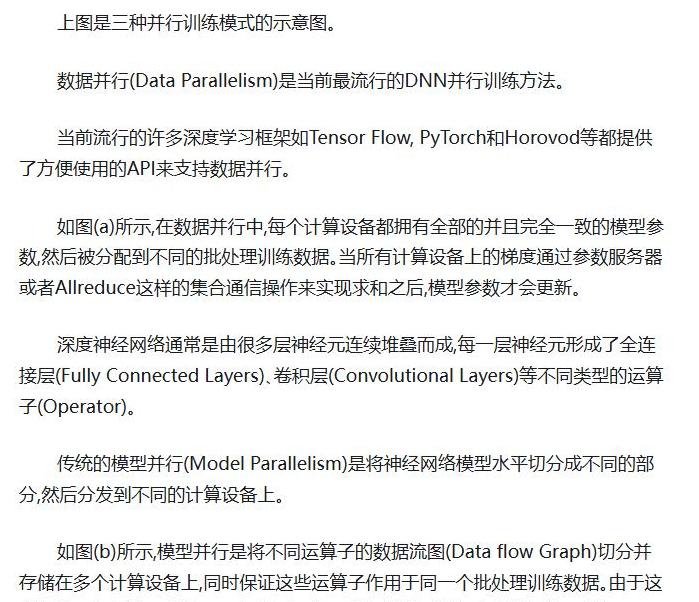

CUDA架构:GPU计算的核心技术

深入研究GPU的驱动力时,李明接触到了CUDA,这是一种特别的编程架构,专门为GPU设计,提供了开发者们所需的工具和库。

就好比,有了更好的画笔和颜料,艺术家才能画出更加绚丽的画卷。

通过CUDA,程序员们能够更高效、更灵活地利用GPU的并行计算能力。

李明对编程一向充满热情,他对这一点有着深刻的体会。

他明白,不同的技术解决方案之间,并不只是模块化的堆叠,而是需要精心设计和良好的协同。

例如,对于一个在自然语言处理上非常有名的AI模型来说,能不能实时翻译取决于它能多快地处理并发数据。

这就牵涉到CUDA的高级应用,把本该线性执行的任务拆解成并行的小任务,再通过GPU快速计算完成。

这一过程,不仅满足了现代应用对实时性的严苛需求,更展开了一幅从算法到实际落地的画卷。

未来展望:AI与高性能计算的结合

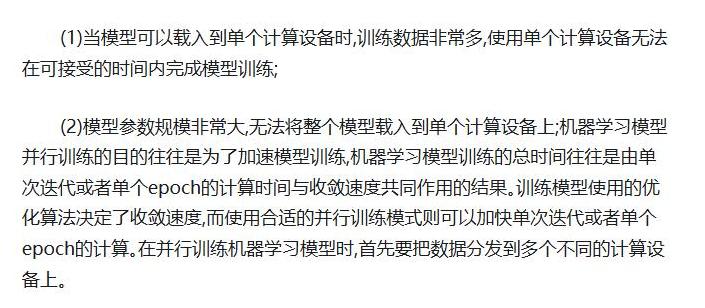

随着下午的阳光渐渐西斜,李明对AI和计算技术有了更深的体会。

他意识到,AI的发展从来不是短期的流行热潮,也不仅限于学术框架上的讨论。

它是一场跨越了多个学科的深刻变革,对我们的生活方式、工作模式乃至对技术伦理都提出了新的挑战。

在不远的未来,随着物联网的发展以及5G技术的普及,人类将越来越需要更加高效的AI解决方案。

在这背后,高性能计算将是关键。

如果说过去的几十年是AI追赶时代的步伐,那么接下来的变革将是AI带领我们迈向一个全新的、高度连接的世界。

李明打包好他的东西,走出咖啡店。

在夕阳的余晖下,他满怀期待地走上了回家的路。

AI和高性能计算让他看到了无限的可能性,也更坚定了他在技术革新道路上勇往直前的决心。

结尾的故事不再只是他个人探索的终点,而是彰显了一种开放的心态和对未来的持续期待。

这场探索中的每一步,都是点亮未来科技之光的热情碰撞。

在这场不断演化的技术变革中,学习永无止境,创新才是动力。