人工智能,曾经的未来憧憬,如今已融入我们生活的方方面面。

从学术研究到日常琐事,AI 似乎无所不能,如同一位博学多才的智者,随时准备解答我们的疑问。

这看似完美的“数字精灵”却频频暴露出令人啼笑皆非的错误,引发了人们的担忧和质疑。

究竟是什么原因导致AI“一本正经胡说八道”?

我们又该如何应对?

AI 的出现最初带给人们巨大的希望,它仿佛能解决各种难题,从撰写论文到制作演示文稿,甚至连生活小常识都能信手拈来。

最近一段时间,越来越多的用户发现,AI 这位“助手”似乎并不总是可靠。

社交媒体上,用户们纷纷吐槽被 AI“坑”的经历,分享那些令人咋舌的错误答案。

这些案例涵盖了各种领域,从学术研究到日常生活。

DeepSeek 曾编造出“郭沫若在甲骨文研究中对‘各’的含义进行考释”这样的无稽之谈,还在汕头特产推荐视频中,列举了根本不存在的店铺。

豆包在回答《水浒传》译者问题时,也出现了张冠李戴的错误。

更令人担忧的是,DeepSeek 甚至能凭空捏造法律条文,让人真假难辨。

大型语言模型(LLM)是 ChatGPT、文心一言、DeepSeek 等生成式 AI 的核心。

它们通过分析海量文本数据学习语言模式,从而生成看似专业的文本。

LLM 并不真正理解文本的含义,缺乏人类的常识和判断力。

它们像一个只会背诵课文的学舌鹦鹉,无法理解其中深意。

AI 的“胡编乱造”源于多方面因素。

训练数据的局限性是关键问题。

AI 只能基于其训练数据生成内容,如果数据本身存在错误、偏见或过时,AI 就会继承这些问题。

例如,许多模型的训练数据截止于2022年或2023年,对于之后发生的事件,AI 只能基于旧数据推测或编造。

AI 的核心功能是根据现有文本预测下一个词。

这种机制导致 AI 在不确定时倾向于生成看似合理的回答,而不是承认“不知道”。

它们被设计成必须给出某种答案,即使是编造的。

再者,AI 缺乏实时验证能力。

与搜索引擎不同,大多数 AI 模型无法实时获取和验证信息。

它们无法像人类一样查阅资料或咨询专家,只能依赖有限的训练数据。

因此,当被问到超出知识范围的问题时,AI 往往会通过“编造”来填补空白。

此外,AI 通常被优化为生成流畅、有说服力的回答,而不是最准确的回答。

如果一个模型被训练成总是给出肯定、详细的回答,它就倾向于编造细节来满足这一要求,即使这意味着提供虚假信息。

DeepSeek 自己也承认,“胡编乱造”源于其技术原理和训练数据的局限性。

2023年,一位美国教授被 ChatGPT 无故列入“有性骚扰行为的法学界人士”名单。

ChatGPT 还捏造了细节,声称该教授在阿拉斯加学生旅行期间有不当行为,甚至引用了一篇虚构的报道作为“证据”,这对教授的声誉造成了极大损害。

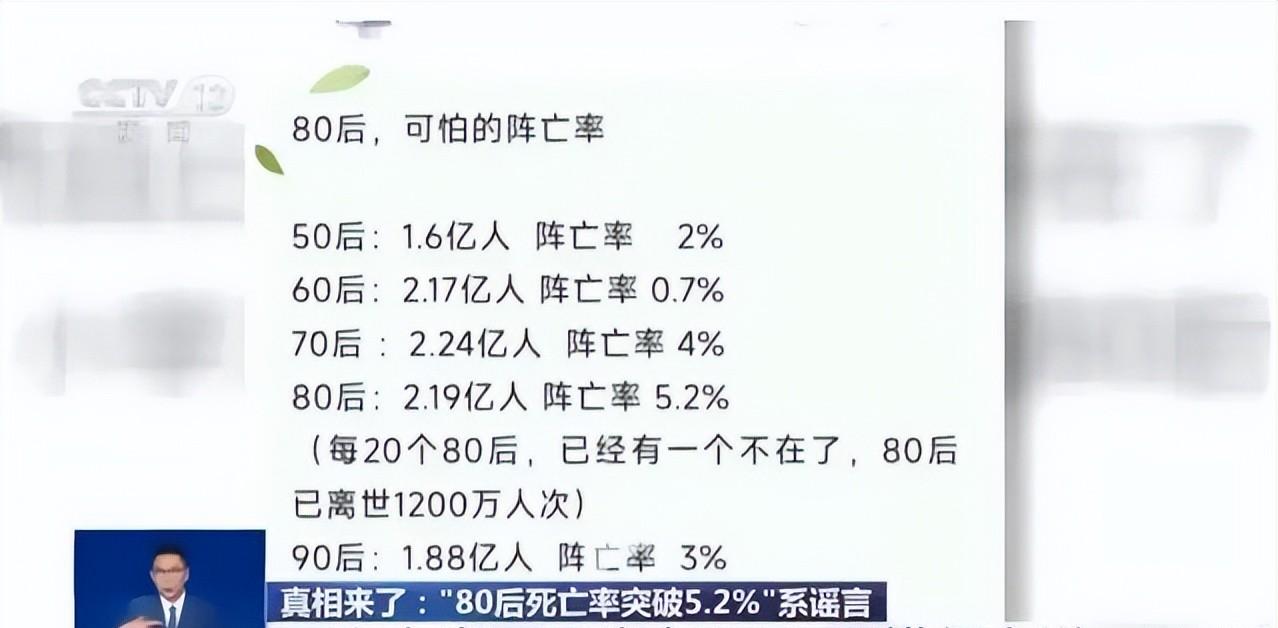

2025年初,公安部网安局公布了一起案例,网民夏某在其发布的视频中引用了一组令人震惊的数据:“截至 2024 年末,80 后死亡率已达 5.2%”。

这组数据引发了广泛恐慌,但最终被证实是 AI 生成的虚假信息。

夏某也因此受到了行政处罚。

面对 AI 的“胡编乱造”,我们必须采取措施防范。

要保持怀疑态度。

无论 AI 的回答看起来多么专业,我们都应保持警惕,尤其是在涉及具体数据、引用来源或历史事件时。

要进行交叉验证。

对于重要信息,最好通过多个渠道验证,例如使用搜索引擎、查阅权威资料或咨询专家。

尤其在学术研究、法律文件或医疗决策等关键领域,AI 的回答只能作为参考,不能作为最终依据。

第三,优化提问方式。

具体的、明确的问题通常能得到更准确的回答。

我们也可以直接告诉 AI,如果不确定答案,就应该明确表示不知道。

第四,利用 AI 的迭代能力。

如果怀疑 AI 的回答不准确,可以提出质疑或要求其重新思考。

多轮对话能帮助 AI 提供更准确的信息。

最重要的是,要保持自己的判断力和批判性思维。

AI 只是工具,最终的判断和决策权在我们自己手中。

研究人员正在努力改进 AI,减少“幻觉”问题。

他们致力于增强模型的事实性验证能力、改进训练方法、增加实时知识检索功能。

一些 AI 已经开始整合搜索引擎功能,可以引用最新的网络信息,提高回答的准确性。

同时,我们也在适应与 AI 共处的环境。

越来越多的人开始了解 AI 的局限性,学习如何合理地利用这一工具。

教育机构开始教授学生如何批判性地评估 AI 生成的内容,媒体也在加强对 AI 相关问题的报道和讨论。

历史上,每一项新技术的出现都会引发一些担忧。

从印刷术到互联网,再到智能手机,人类总是担心新技术会改变我们的生活方式和思维模式。

对 AI 的焦虑,也是这种历史模式的重演。

现在,大部分 AI 都会提醒“内容由 AI 生成,请仔细甄别”。

但如果我们盲目迷信 AI,最终被“背刺”的,将是我们自己。

AI 的未来会如何发展?

我们又该如何在享受 AI 便利的同时,保持独立思考的能力?

这值得我们深入思考和探讨。