在一个阳光明媚的下午,小明和他的朋友们在咖啡厅讨论最近的科技新闻。

他们谈到了最近的一项重大突破:一群来自斯坦福大学的研究人员,依靠不用卷积和GAN的新方法,改进了图像tokenizer的性能。

小明好奇地问:“为什么图像tokenizer这么重要?”他的朋友小丽则说,“计算机看世界的方式,和我们人类完全不一样,一张简单的猫咪照片,对AI来说就是一堆无数个数字。”

坐在一旁的技术达人小张点了点头,开始给大家讲解这个新技术的妙处。

识别图像:AI模型的压缩挑战任何人都知道,当我们看到一张猫咪照片时,很容易认出那是一只猫。

但同样的一张照片,到了计算机眼里,变成了一个庞大的数字矩阵。

假如这张照片是1000×1000像素的彩色图片,它其实是一组300万个数字的数据集合。

每个数字代表一个像素点的颜色深浅,从0到255不等。

所以,小张接着解释,为了让AI更有效地学习这些图像内容,需要先把图片压缩。

这个过程就叫tokenization,而执行这个操作的组件则叫做tokenizer。

简单来说,tokenizer的目的是把原始图片压缩到一个更小、易处理的空间,以便生成模型能更高效地学习和生成新的图像。

当前最先进的图像生成模型,会在第一步就进行tokenization。

这不仅提高了学习效率,也使得生成模型能够更好地重建图像。

那么,如何得到一个更有效的tokenizer成了科研人员的关键关注点。

上周五,斯坦福大学的研究人员发布了一篇新论文,介绍了他们的新方法,命名为“FlowMo”。

这个名字听起来很时髦对吧?

小丽笑着问大家是否知道这个名字背后的含义。

小明好奇地问道:“它真的有那么特别吗?”

小张回答说,确实特别。

FlowMo的训练包括两个阶段:第一个阶段是学习如何全面捕捉图像的多种可能重建结果;第二个阶段则是从这些可能重建结果中选择最接近原图的方案。

这种方法既保证了图像重建的多样性,又提高了重建质量。

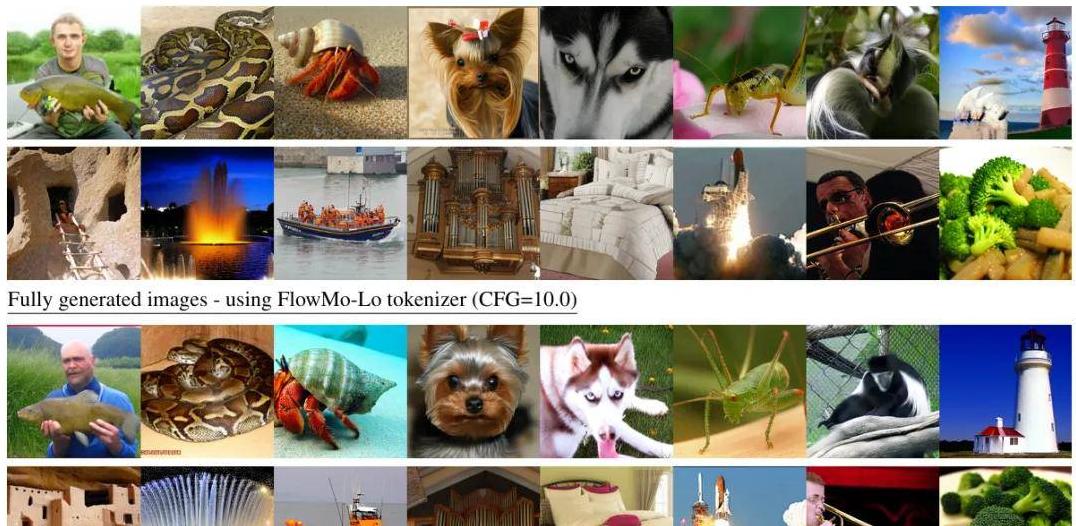

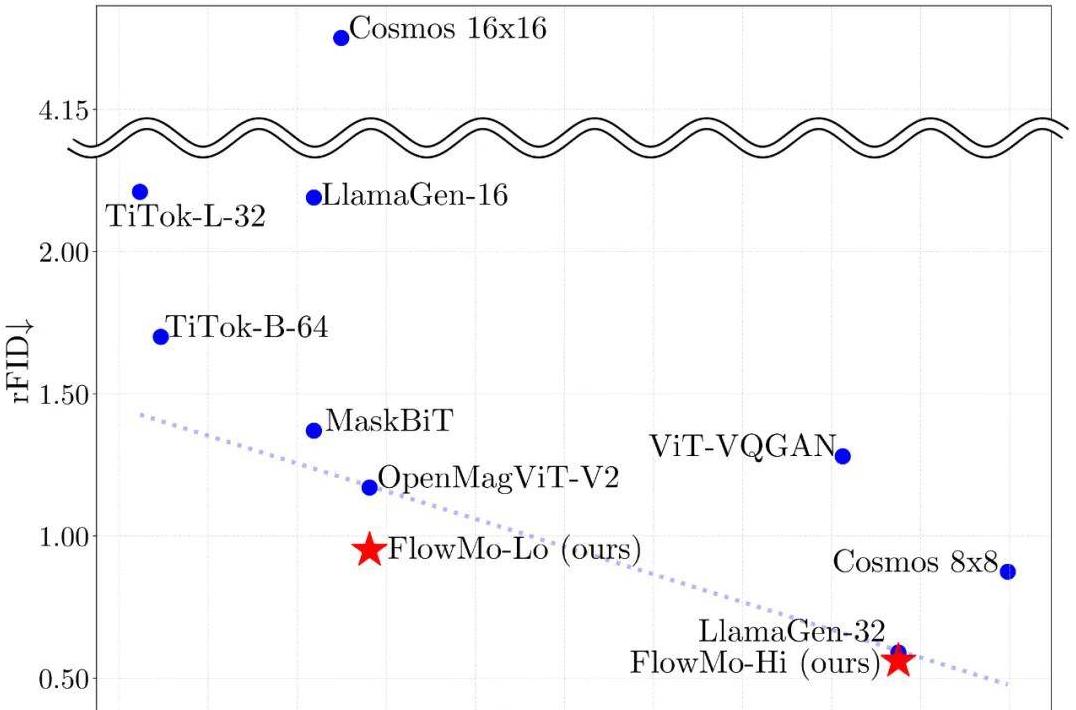

在ImageNet-1K数据集上,FlowMo展现出了领先的重建性能。

你可能会问,这有什么特别呢?

小张进一步解释道,现有的先进图像生成系统通常采用两阶段设计:先压缩,再生成。

而传统的tokenizer常常使用卷积和对抗损失等技术,不仅复杂还耗时。

FlowMo则是一种基于Transformer的扩散自编码器,无需卷积和对抗损失,让整个过程简单明了却不失效果。

实验分析:性能与创新的结合一个技术是否真的先进,要看实验结果。

小丽提出了一个问题:“FlowMo真的有那么好吗?”

小张点点头,接着说:“实验结果告诉我们,是的。”

具体来看,FlowMo在不同的比特率设置下,如0.07 BPP和0.22 BPP,都展示了出色的性能。

拿重建FID(rFID)指标来说,在0.07 BPP设置下,FlowMo的rFID为0.95,比之前的OpenMagViT-V2的1.17进步不少。

在0.22 BPP设置下,FlowMo的rFID为0.56,略优于LlamaGen-32的0.59,都是目前最好的结果。

此外,研究团队还进行了大量消融实验,分析了FlowMo设计中的关键决策:噪声调度、量化策略、模型架构和后训练策略等。

他们发现,一些关键创新,无论是thick-tailed logit-normal噪声分布还是shifted sampler,对模型性能都有重要作用。

小明听得入神,问道:“那FlowMo还有什么特别之处吗?”

小丽笑了,“FlowMo的特别之处还在于它不依赖于已有的tokenizer,就能实现出色的图像tokenization。”

这意味着它是一种更简单、通用的方法,有望在更多的应用场景中发挥作用。

FlowMo在生成任务中的表现与挑战

当然,技术的实际应用也是重要的。

小张继续解释说,“拿生成任务来说,FlowMo表现得也不错。

在一些指标上,基于FlowMo的生成模型(MaskGiT)甚至优于基于OpenMagViT-V2训练的模型。”

不过,他补充道,尽管在很多指标上领先,FlowMo在FID这一指标上还稍显逊色(4.30 vs 3.73),这显示了tokenizer与下游生成模型之间存在复杂关系,需要进一步研究。

小明若有所思地点了点头。

他意识到,尽管技术进步很大,但总有一些挑战需要克服。

小丽补充道,这也正是科研的魅力所在,每一点进步都是无数次探索和实验的结果。

结尾日暮时分,咖啡厅的灯光悄悄亮起,小明感叹道,“听起来,FlowMo不仅是一个技术上的突破,也让我们看到科研的无限可能。”

小张笑着说,“是啊,科研正是这样,每一次突破都是为了找到更高效、更简单的解决办法。”

这场讨论就像是一次科技小课堂,不仅让小明更了解了图像tokenizer的世界,也让大家对科技研究充满了新的期待和思考。

科技的进步总是在改变我们的生活,让曾经复杂的问题变得简单、可行,而科研人员的不断努力和创新正是推动这一切的力量。

让我们期待下一个科技奇迹的到来。