本文内容均是根据权威资料,结合个人观点撰写的原创内容,文中已标注文献来源及截图

文 | 实用电脑手机技巧

编辑 | 陆陆叁

【前言】

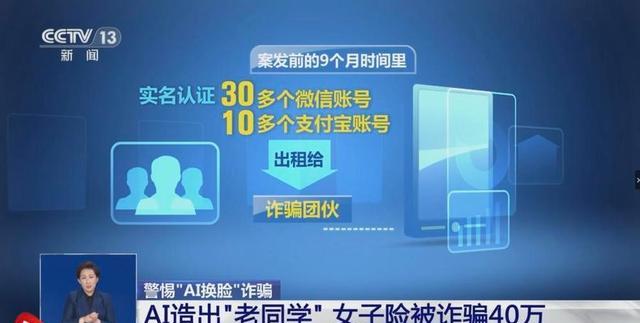

时代在进步,科技在进步,诈骗也同时在进步,如今新型诈骗已经被央视曝光,那就是AI换脸诈骗。

这种诈骗手法防不胜防,特别是一些不懂新科技的老年人,诈骗成功率甚至高达100%,如此高的成功率,究竟该如何防范呢?

【AI诈骗的核心技术及其实施手段】

随着AI技术的不断进步,诈骗分子开始利用这些先进技术来实施更加隐蔽和难以识别的诈骗行为,其中最为常见的三种技术手段包括AI换脸技术、AI语音合成技术和大数据筛选技术。

AI换脸技术的应用让诈骗分子能够轻松地伪装成受害者的亲朋好友,这种技术只需要一张照片,就能实时修改视频中的人脸,生成高度相似的伪装人物。

例如在一起真实案例中,小李接到了一个自称是他同学的视频电话,视频中的同学面容和声音都与真人无异,急切地要求小李转账3000元,由于视频通话的逼真程度,小李没有丝毫怀疑就完成了转账,直到事后才发现自己被骗。

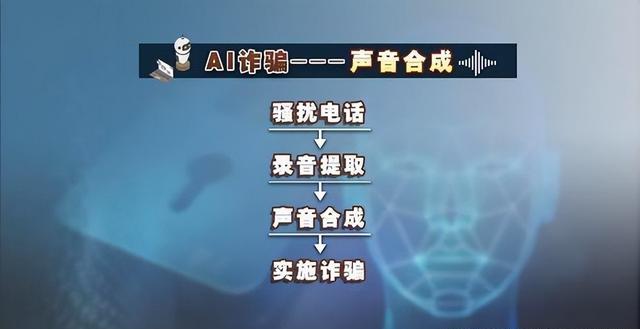

AI语音合成技术更令人胆寒,诈骗者仅需数秒语音样本,即可生成极为逼真的语音替身,连语气与情感都能调整。

小王就是这种技术的受害者之一,他接到了一个听起来完全像是老板的电话,对方声音焦急,说遇到了紧急情况需要钱,由于声音与真人毫无差别,小刘立即转账2万元,后来才知道这是一场精心设计的骗局。

AI换脸和拟声技术的结合,使得诈骗手段变得更加高明,诈骗分子可以轻松地冒充受害者的亲朋好友,进行逼真的视频或语音通话。

这种技术的成功率之高令人咋舌,据统计此类诈骗手段的成功率接近100%,主要是因为AI技术生成的图像和声音极为逼真,普通人几乎无法辨别真伪。

大数据筛选技术则让诈骗变得更加精准和个性化,诈骗分子通过分析社交媒体上的动态、兴趣爱好和职业习惯,精准地筛选出目标人群,然后量身定制诈骗方案。

AI技术在诈骗中的应用之所以如此成功,很大程度上是因为其生成的视频和声音极为逼真,即使是经验丰富的人也难以辨别真伪。

这类诈骗手段主要针对的是对新技术不太熟悉的普通人,尤其是老年群体,他们可能缺乏对AI技术的了解,也不太可能想到有人会利用如此高科技的手段来行骗,这使得他们成为了最容易上当受骗的群体。

然而AI技术并非完美无缺,仔细观察我们可能会发现一些微妙的异常,在AI生成的视频中,人物的眨眼频率可能会异常,或者嘴部运动与发音不完全匹配,这些细微的差异,成为了识别AI诈骗的重要线索。

值得注意的是老年人群体由于听力和视力的退化,更容易成为AI诈骗的目标,他们可能无法察觉到这些细微的异常,从而更容易被骗子蒙骗。

在一项针对老年人的测试中,10位参与者全部未能正确区分AI合成的声音和真实声音,这一结果令人震惊。

此外公众人物也面临着特殊的风险,由于他们的照片和声音样本容易被获取,诈骗分子可能会利用这些信息来制作假冒视频或音频,误导粉丝或公众。

【AI诈骗的威胁与防范难点】

这种新型诈骗方式之所以如此难以防范,主要源于其极高的隐蔽性和对人性弱点的精准利用,AI诈骗的隐蔽性体现在多个方面。

首先AI技术能够生成极为逼真的视频和音频,使得受害者难以辨别真伪;其次AI算法可以模仿目标人物的语言习惯和表达方式,使得诈骗对话更加自然流畅,这种高度仿真的交互方式,极大地降低了受害者的警惕性。

更为棘手的是AI诈骗往往巧妙地结合了情感因素,精准地瞄准了人们的心理防线,骗子们通过分析社交媒体数据和个人信息,构建出详细的个人档案,从而能够精准地模仿受害者的亲友。

他们利用这些信息编织出令人信服的情境和故事,触动受害者的情感神经,无论是亲情、友情还是职场关系,都可能成为骗子利用的突破口。

AI诈骗的高成功率也反映了当前社会在应对新型技术犯罪方面的不足,传统的防诈骗教育和技术手段,在面对这种高度智能化的诈骗时,往往显得力不从心。

这种情况下,受害者在事后回想时常常感到既痛心又懊悔,因为当时的自己完全没有察觉到任何异常。

更为严重的是AI诈骗不仅威胁个人财产安全,还对整个社会的信任体系造成了严重冲击,当人们无法确定与自己交流的是否是真实的亲友时,社会交往的基础就会受到动摇。

这种信任危机可能会延伸到更广泛的社会领域,影响人际关系、商业往来甚至公共事务。

面对AI诈骗带来的挑战,社会各界需要共同努力,寻找平衡技术发展和安全保障的方法,这包括加强技术防范,如开发更先进的AI识别系统。

完善法律法规,明确AI诈骗的界定和惩处标准;加强公众教育,提高大众对新型诈骗手段的认知和警惕性,只有多管齐下才能在享受科技进步带来便利的同时,有效防范AI诈骗带来的风险。

【应对AI诈骗的防范建议】

面对如此高明的诈骗手段,我们该如何保护自己和身边的人呢?以下是一些实用的防范建议:

首先多渠道核实身份是至关重要的,无论收到多么紧急的转账请求,都应该通过其他渠道再次确认。

其次保护个人信息也是防范AI诈骗的关键,在社交平台上应该谨慎发布个人信息,尤其是照片和语音。

这些信息可能被不法分子用来生成AI换脸或语音克隆,同时也要避免在未知平台留言或随意接听陌生电话,以减少语音样本被采集的风险。

教育和提高意识同样重要,家庭成员之间应该定期交流防骗知识,特别是要关注老年人群体,帮助他们提高对新型诈骗手段的认识,每个人都应该保持高度警惕,对任何涉及财务的请求都要格外小心。

在技术层面,安装正版的防病毒软件,定期检查设备安全,也是防范AI诈骗的有效手段,这些措施可以帮助我们及时发现和阻止可能的数据泄露或恶意软件入侵。

【AI诈骗的国际影响与法律应对】

AI诈骗已然成为全球性问题,2023年3月,美国联邦贸易委员会(FTC)发布警告,提醒公众谨防利用AI技术的语音克隆诈骗。

FTC特别指出骗子可能会利用社交媒体上公开的声音片段来模仿亲友的声音,实施诈骗,这一警告反映了AI诈骗问题的严重性和普遍性。

在中国,相关部门也采取了积极的应对措施,2023年8月,中国最高人民法院、最高人民检察院和公安部联合发布了《关于依法惩治利用人工智能技术实施电信网络诈骗等犯罪的意见》。

这份文件明确将利用AI技术实施的诈骗行为纳入刑法打击范围,并提出了具体的司法解释和量刑建议,这一举措表明法律正在努力跟上科技发展的步伐,为打击新型犯罪提供法律依据。

【结语】

AI诈骗的出现,给我们敲响了警钟,它提醒我们,在享受科技进步带来便利的同时,也要时刻保持警惕。

面对这种新型诈骗手段,我们需要不断学习、更新防范意识和技能,只有这样才能在这个快速变化的世界中,保护好自己和身边的人,让我们共同努力,提高警惕,抵御AI诈骗的侵害,维护一个安全、可信的社会环境。