我们从人工智能时代过渡到了通用人工智能时代,或许就是几年的事。因为现在AI技术发展得太快了,现在人类还想着需要解决哪些问题,但到了AGI时代人类只需要发现问题就行了,解决问题已经不是我们的强项了。我们只需要提高发现问题的能力就可以了,那么未来我们怎样才能提高发现问题的能力呢?

我觉得第一;要有广阔的知识面,这个世界万事万物都是相互关联的,所有的学科知识都有联结,交叉学科是最能出成果的领域,跨学科思维是最难能可贵的特质。第二要对宇宙,自然生命充满好奇心,科学就是好奇心的产物。因为好奇我们才会问出无数个为什么,每一个为什么都是发现了一个好问题。一定要鼓励孩子多问为什么

第三,要学习思考的技术比学知识更重要的是学习思维。小学生学习科学,重点是学习如何像科学家一样思考,而不是死记硬背那些科学知识点,高质量的思考是有具体的技术和工具的,这就是批判性思维。在AGI时代什么是无用的能力?一是考试刷分的能力,二是死记硬背的能力,第三外语的读写能力。现在AI翻译已经比人做得更好

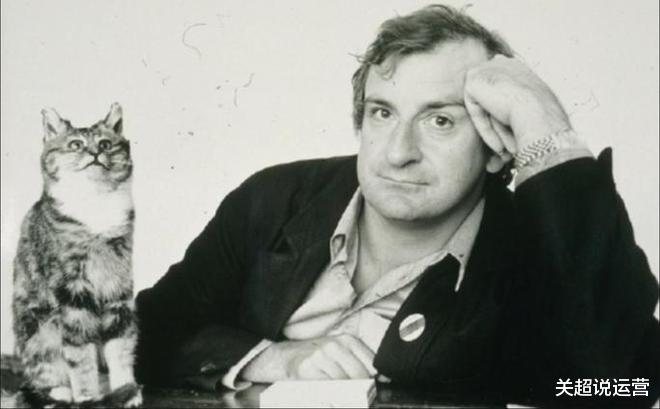

但是听说能力还是不可或缺的,因为语言的语法还有使用习惯问题,同声传译是不可能真正做到实时的,如果你自己有外语听说能力,和老外交流起来能够提供的情绪价值,一定是比借助翻译器更多更高效的,为什么那么多人对AI感到害怕呢?英国著名科幻作家道格拉斯.亚当斯,早在二十多年前提出了一个非常幽默的“亚当斯科技三定律”

定律一;任何在我出生时已经存在的科技,都是世界运行中稀松平常的组成部分,天然,合理且无需质疑。定律二;任何在我十五到三十五岁之间诞生的科技,都是具有革命性的,能够改变世界的重大突破,定律三;任何在我35岁之后出现的科技,都是违反自然规律的异端,可能威胁既有的社会秩序。我们对AI的恐惧看上去也完全符合亚当斯科技三定律。

目前全世界的主流共识,是AI并不会把人类带往一个更糟糕的时代,否则全世界对AI的发展也不会那么热衷了。中国出了一个DeepSeek让我们看到中国在AI技术上能够赶超美国的可能,我们全体国民跟打鸡血一样兴奋。这足以说明大多数人都会认为,AI能让一个国家变得更强大,AI的价值观是否需要与人类对齐呢?

让AI的价值观与人类的对齐在短期内是重要的,但是长期来看是没有意义的。AI的目标如果与人类的目标不一致,那就有可能导致灾难性的后果。比如你给AI的指令是尽可能多生产纸张,如果AI没有与人类的价值观对齐,就有可能AI不顾一切的疯狂生产纸张,直到把地球上的所有能够生产纸张的资源全部耗尽为止。但这显然不符合我们人类的目标,

所以让AI,尤其是AGI理解并学习人类的目标,比如我们可以把大目标设定为;让全体人类过上越来越美好的生活,并且生生不息的繁衍下去,这样一来AGI在执行具体的动作的时候,如果发现这个动作和大目标不一致,那就能及时自动刹车。但是经过深入思考,我们很快会发现,这个想法很美好,但实现起来困难重重。这有点像阿西莫夫的机器人三定律,看是滴水不漏,实则漏洞百出。

比如刚才给AGI设定那个目标,听上去很美好,但AGI最终可能会发现,制造一个像黑客帝国这样的母体养殖场,让人类一出生就活在虚拟世界中,把每个人都圈养起来。这可能是实现大目标的最佳路径,但是这显然不符合人类价值观。也就是说我们给AGI设定任何目标,到头来都可能事与愿违。因为AGI一直在进化,而人类永远停留原地了。